提要:互联网、社交媒体和 AI 的叠加,赋予了个人超越传统企业的执行力。现在的瓶颈已从资源匮乏转向目标模糊与注意力涣散,真正的门槛在于能否将这种“神级杠杆”转化为持续的交付。

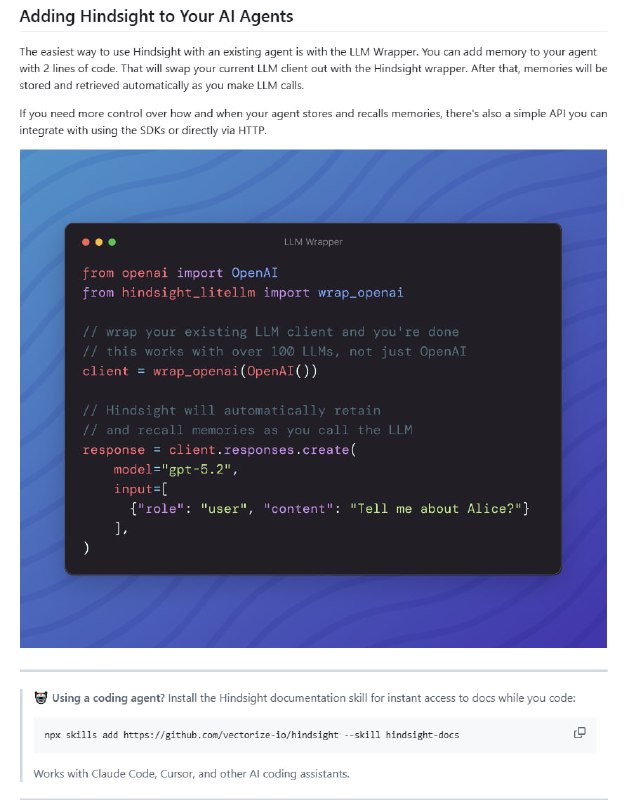

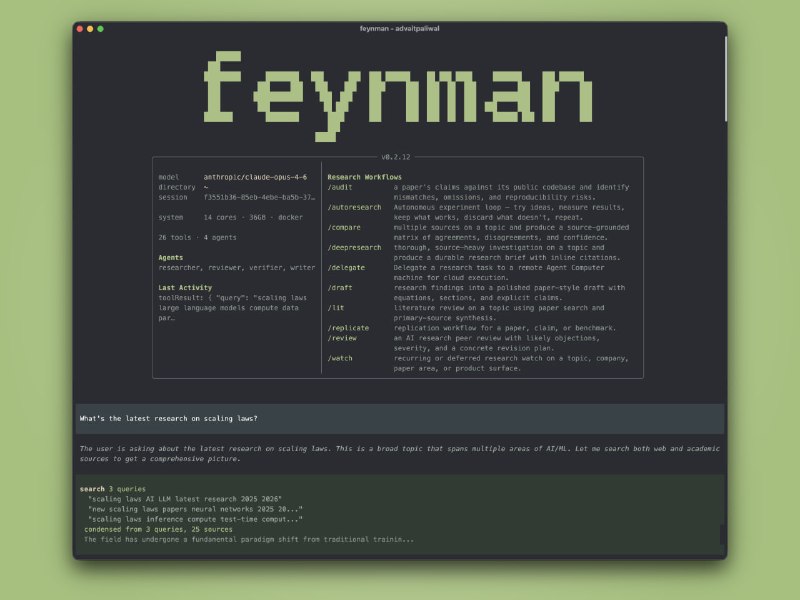

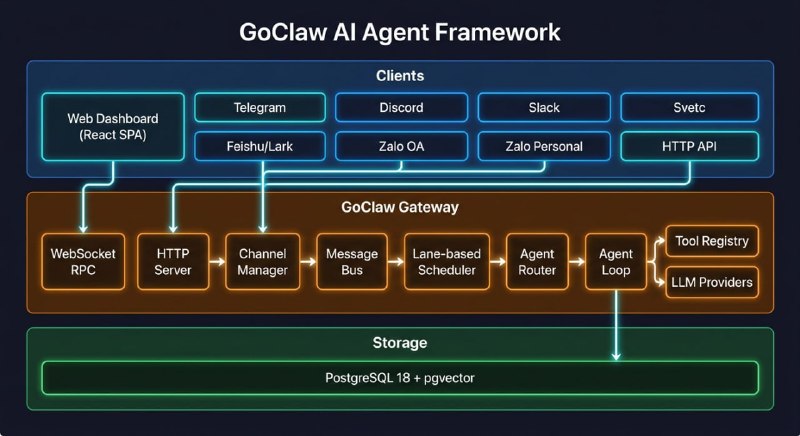

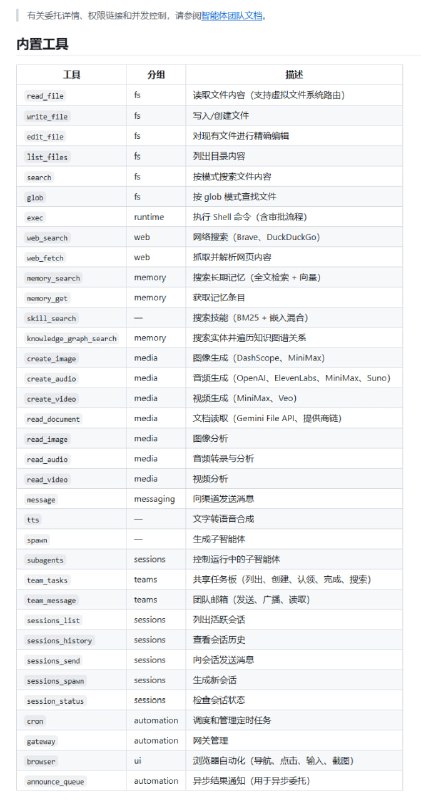

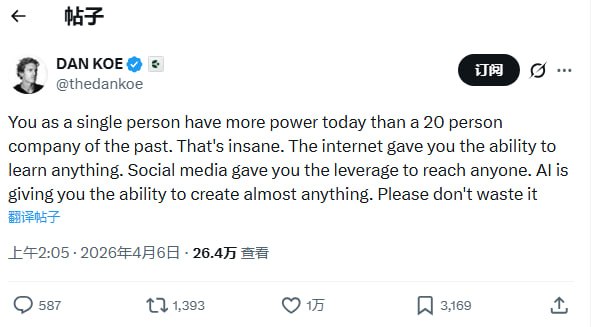

现在的局面挺荒诞的。你手里握着的工具集,足以让一个过去需要 20 人团队、大量资本和分发渠道才能启动的项目,在你的卧室里完成。互联网抹平了知识的门槛,社交媒体拆掉了传播的围墙,而 AI 正在接管生产环节。

这听起来像是某种权限升级,但实际运行起来却像是一场大规模的系统溢出。

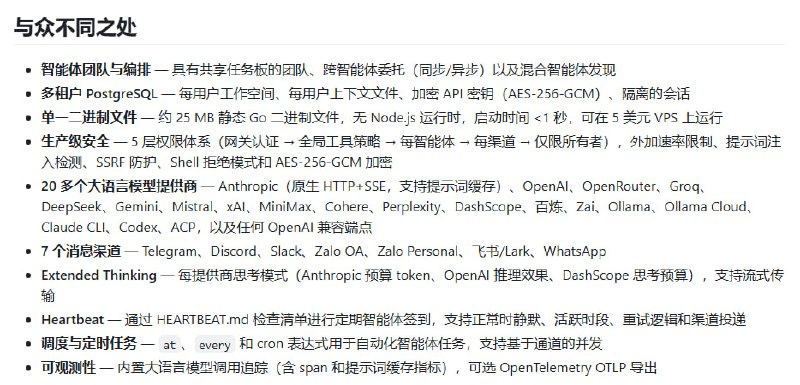

有观点认为,这种能力的扩张其实带来了一种新的“通胀”:当获取知识、触达用户和创造内容都变得廉价时,由于每个人都拥有同样的底座,竞争的基准线被整体抬高了,想要脱颖而出反而更难。

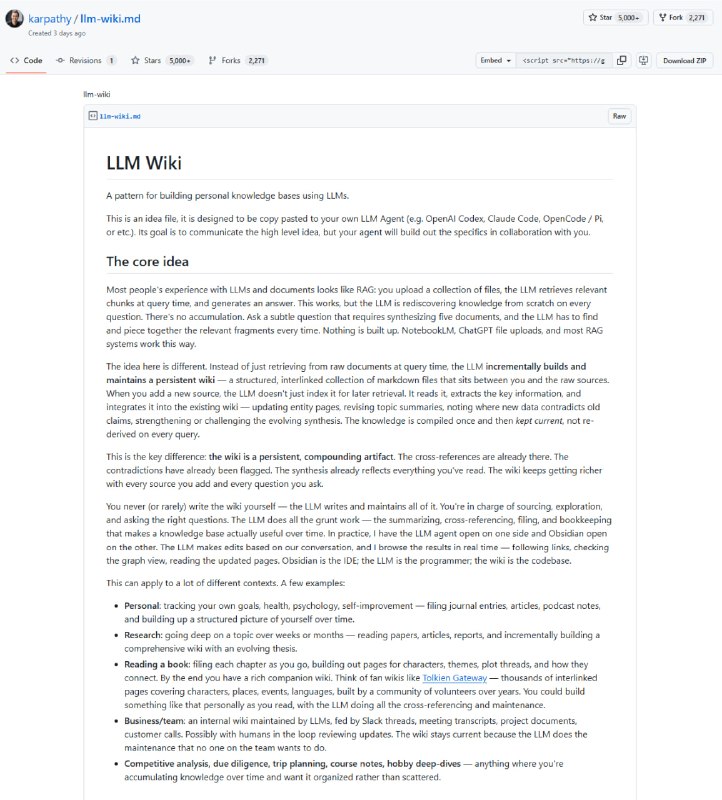

最有趣的地方在于,现在的瓶颈不再是硬件配置(资源),而是软件逻辑(意志与目标)。

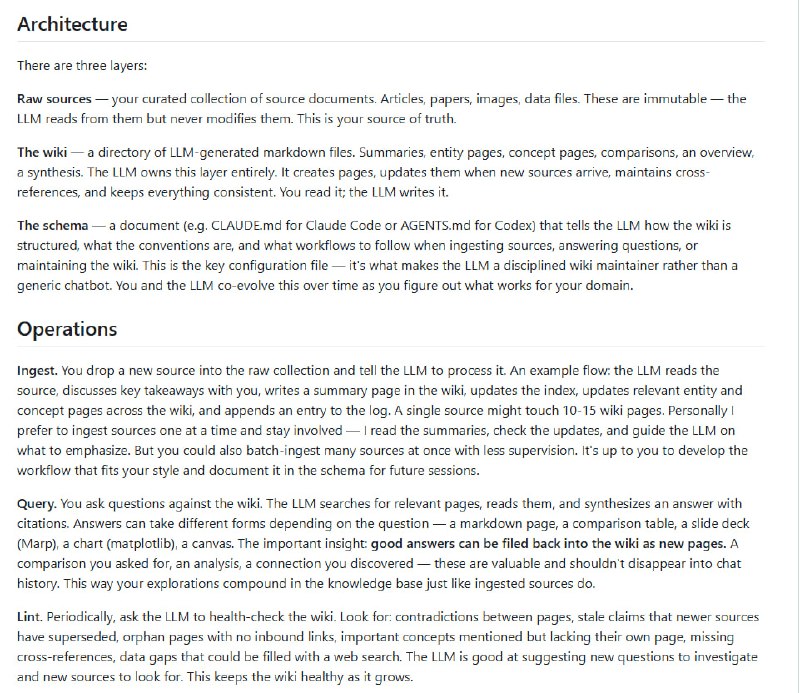

很多人下载了一堆 AI 工具,跑了一周流程,最后又回到了便利贴时代。有网友提到,这种“权力”如果不配合一套完整的系统和流程,本质上只是包装得更漂亮的噪音。更有意思的是,大家拥有了企业级的生产力,却依然保持着消费者的行为习惯——用足以驱动帝国的算力去刷 15 秒的短视频,在评论区争吵。

这种错位就像是拥有一台超算,却只用来玩扫雷。

有人觉得这是一种极其危险的资源浪费。当工具已经进化到可以实现“无限可能”时,唯一的稀缺品只剩下“意愿”。如果你的目标感是模糊的,那么这些无穷无尽的选择非但不会助你成功,反而会让你在无限的路径中陷入死锁,最终因为过载而宕机。

不过也有不同的声音。有网友指出,技术的复杂度其实也在同步提升,单纯靠 AI 并不代表可以取代深度的专业判断和经验积累。

现在的规则已经重写了。如果你还在试图用旧时代的“雇佣兵模式”去对抗这种规模化的个体杠杆,可能真的会被甩在后面。

但这背后还有一个没被解决的问题:当执行的门槛降到近乎为零时,我们该如何定义“价值”?