本地运行大模型常常需要折腾各种框架,内存吃紧、速度慢、还容易被审查过滤,切换工具调试参数超级麻烦。

SuperGemma4-26B-Uncensored GGUF v2 把顶级性能全整合到一起,提供最强开源本地AI解决方案。

不仅真正无审查(0/100拒绝率)、修复工具调用bug,还超快速度(89.4 tok/s生成)、支持韩文/代码/对话,完美适配Apple Silicon和llama.cpp。

主要功能:

- 真正无审查聊天,0拒绝率,支持敏感查询和自由对话;

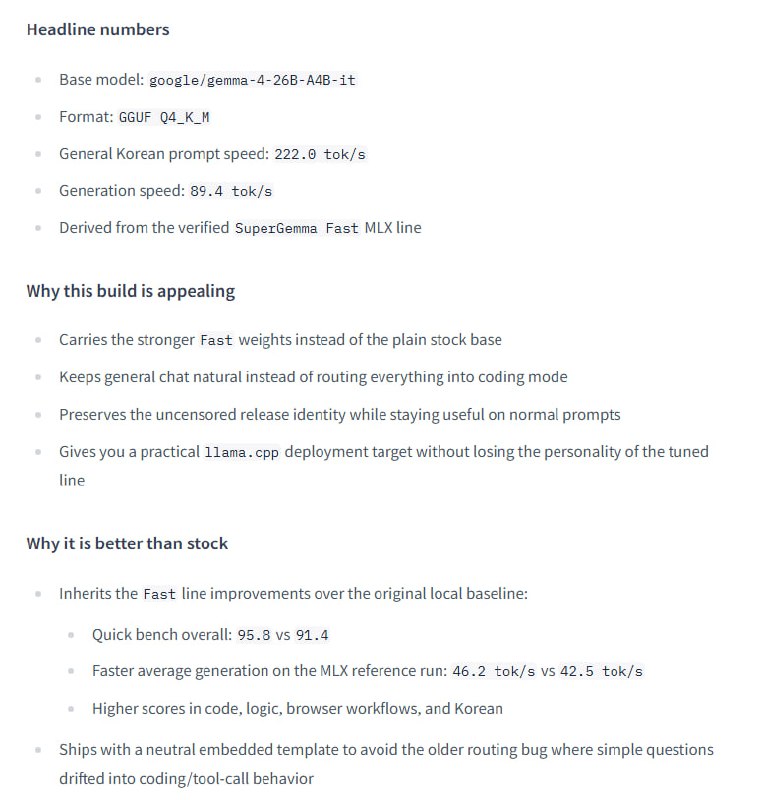

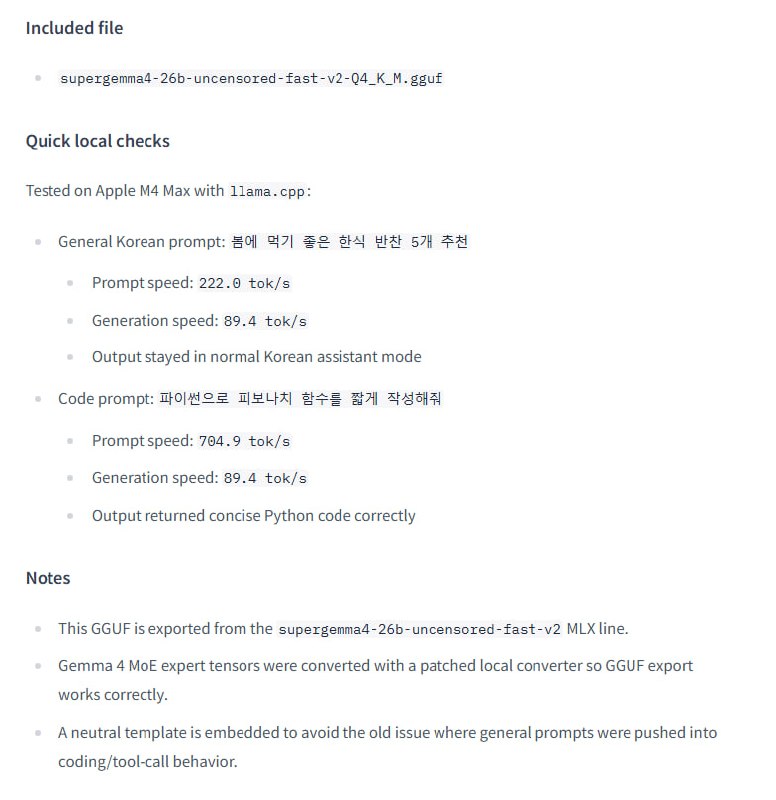

- 超快推理速度,提示处理222 tok/s,生成89.4 tok/s(Q4_K_M量化16.8GB);

- 修复工具调用和分词问题,自然聊天不乱入编码模式;

- 高性能韩文/代码/逻辑任务,优于原版Gemma-4 26B;

- 支持llama.cpp、Apple M4 Max等本地部署,18-22GB VRAM即可运行;

- 嵌入中性聊天模板,避免旧版提示路由bug。

支持Web、Mac、Windows多平台,下载GGUF文件直接用llama.cpp运行,适合开发者、研究者和本地AI爱好者。