在线训练PyTorch构建块,专为 OLMo 生态系统打造,助力大规模语言模型开发。

AllenAI推出的

OLMo-core,集成了训练、推理的全套模块,不仅提供了官方训练脚本支持多GPU分布式训练,还能无缝接入 Hugging Face Transformers 和高效的 vLLM 推理引擎。

主要亮点:

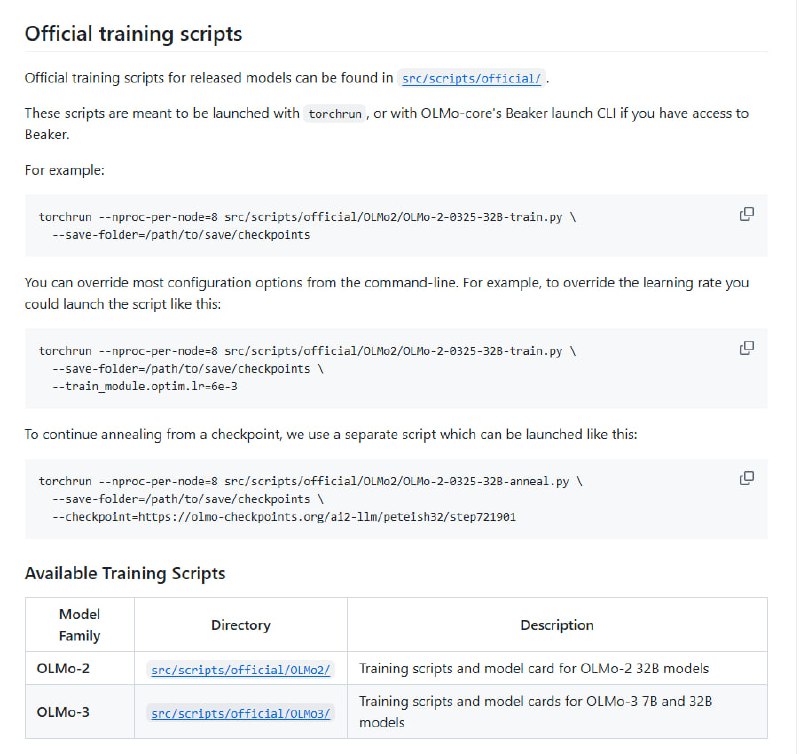

支持最新的 OLMo-2(32B)和 OLMo-3(7B/32B)模型训练脚本;

兼容 PyTorch,支持 torchrun 与 Beaker 一键分布式启动训练;

提供多种可选依赖支持加速(flash-attn、TransformerEngine、torchao 等);

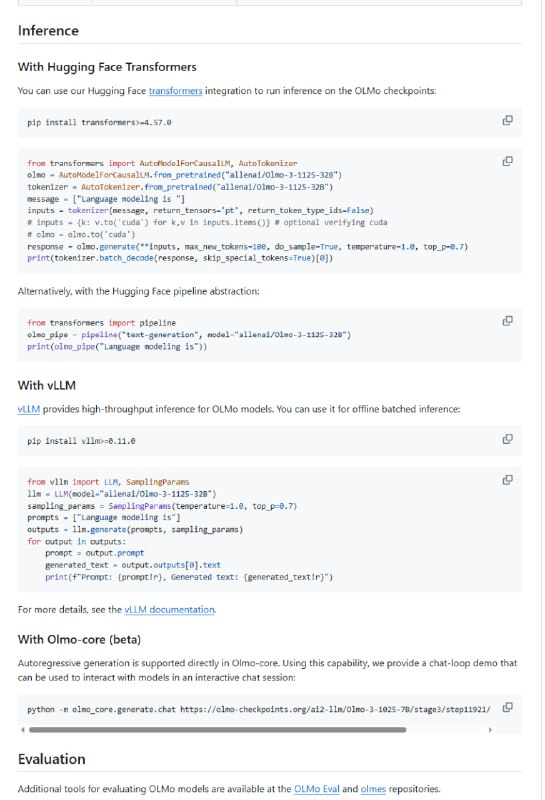

通过 Hugging Face Transformers 和 vLLM 实现高效推理,加速模型部署;

提供交互式聊天演示和评测工具,方便研究和测试;

Docker 镜像包含所有依赖,便于快速启动环境。

安装简易,pip 安装即用:

pip install ai2-olmo-core

官方文档:olmo-core.readthedocs.io适合科研人员、AI工程师、NLP开发者使用,全面提升大模型训练与推理效率。