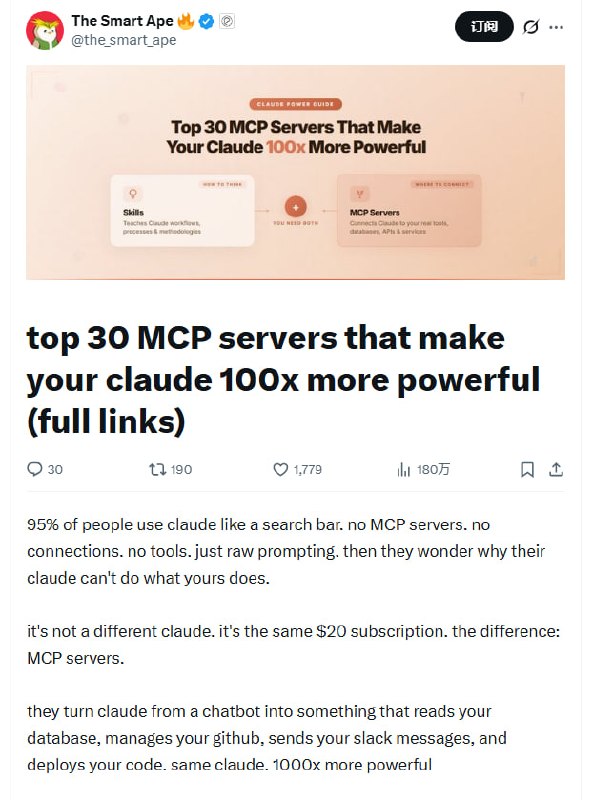

Claude 最强进化指南:30 个必装 MCP 服务全解析 |

推文 |

#指南很多人把 Claude 当成加强版搜索框,这其实是最大的浪费。

你和顶级开发者的差距不在模型本身,而在 MCP(模型上下文协议)。没有 MCP,Claude 只是一个满腹经纶却无法出门的职员;有了 MCP,它就拥有了直接操作数据库、管理 GitHub、发送 Slack 消息和部署代码的双手。

以下是让 Claude 强力进化的 30 个顶级 MCP 服务及核心逻辑。

1. 认知升级:技能(Skills)与 MCP 的本质区别

很多人分不清这两者。

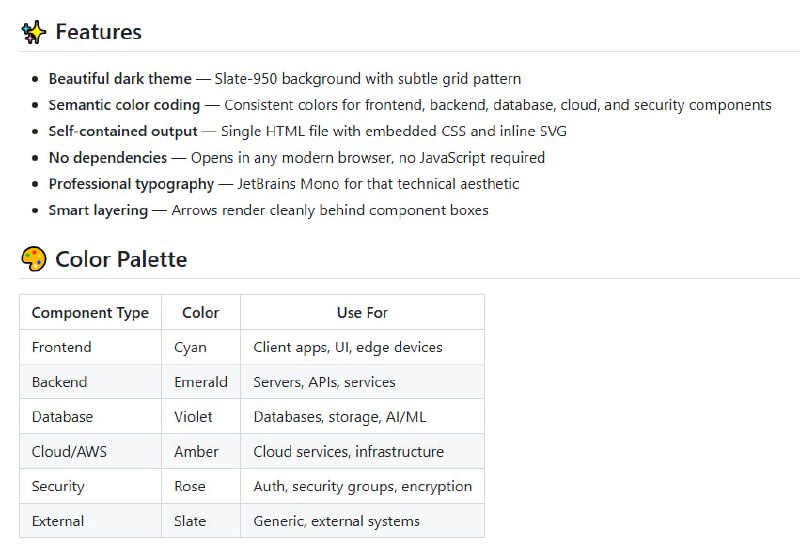

技能教 Claude 如何思考(How to think)。它是方法论,比如如何写 PRD、如何做测试驱动开发。

MCP 给 Claude 访问权限(Where to act)。它是连接器,是通往 GitHub、Slack、数据库的桥梁。

有技能没 MCP,是空有理论的专家,进不去公司大门;有 MCP 没技能,是拥有所有钥匙的保安,却不知道该干什么。顶级玩家永远是两者兼备。

2. 资源地图:去哪里寻找你的武器

生态正在爆炸式增长,不要重复造轮子。

+

官方参考实现+

官方注册表(App Store)+

社区精选列表+

在线运行环境3. 30 个必装 MCP 服务清单

开发与协作

+ GitHub MCP:必装之首。让 Claude 读代码、开 PR、审 Issue、跑流水线。

+ Playwright MCP:浏览器自动化。Claude 可以像真人一样操作网页、截图、验证前端逻辑。

+ Sentry MCP:线上报错直连。Claude 直接读堆栈信息,分析生产环境 Bug 并给出修复建议。

+ Semgrep MCP:代码安全审计。在漏洞上线前,让 Claude 帮你过一遍安全扫描。

+ CircleCI MCP:调试构建失败的利器,不再需要手动复制粘贴日志。

数据库与数据分析

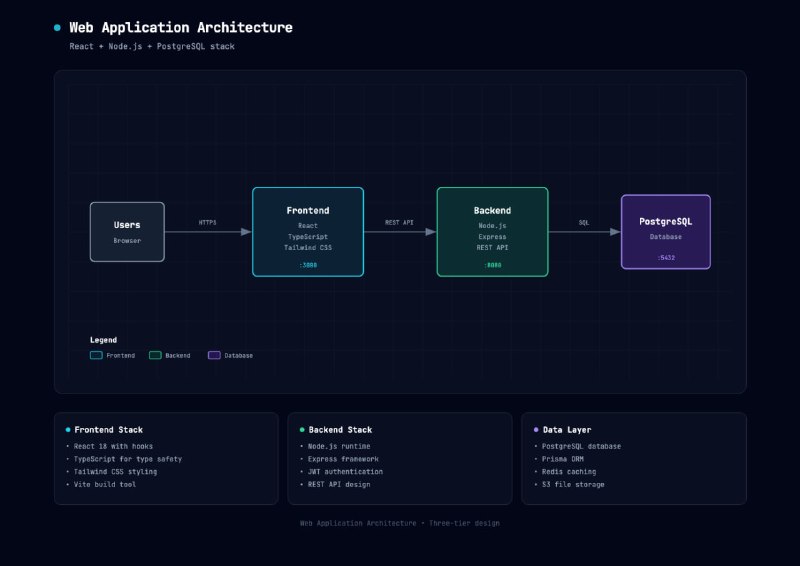

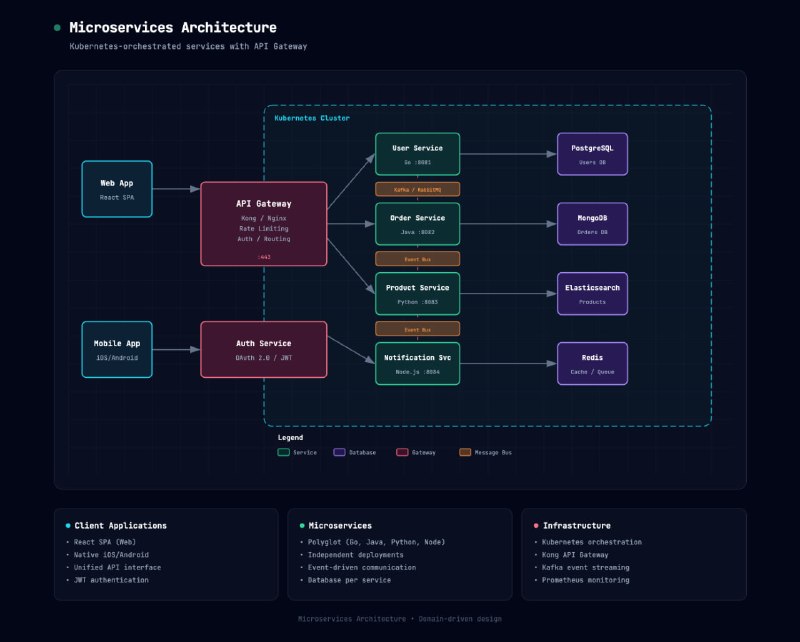

+ PostgreSQL / Neon MCP:Claude 直接查询数据库、检查 Schema,甚至帮你做数据迁移。

+ Supabase MCP:管理后端全家桶,从 Auth 到 Edge Functions,Claude 成了你的后端管理员。

+ Neo4j MCP:处理复杂关系。让 Claude 在图数据库里导航,寻找数据间的深层联系。

+ Qdrant MCP:赋予 Claude 长期记忆。通过向量搜索,让它建立属于自己的语义知识库。

+ Tinybird MCP:实时分析海量数据。不用写 SQL,直接用自然语言问 Claude 业务指标。

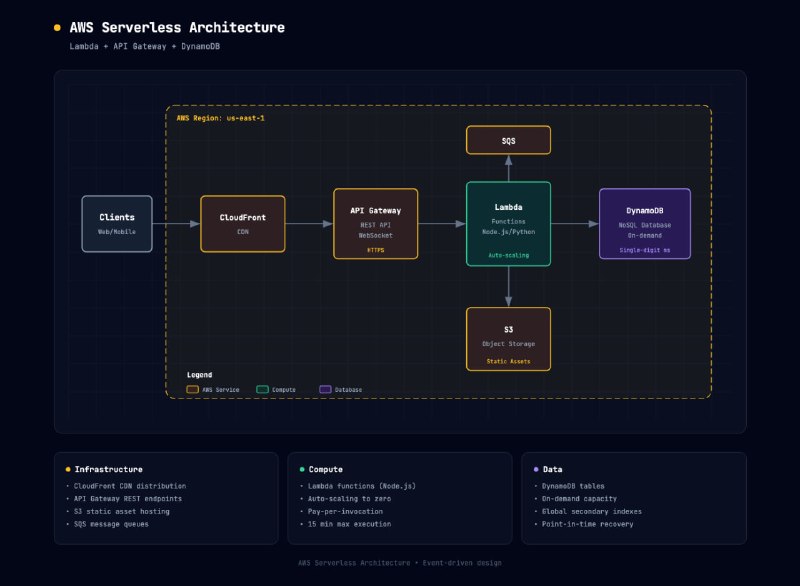

云原生与基础设施

+ AWS Suite:从成本分析到 CDK 建议,Claude 成了你的云架构师。

+ Cloudflare MCP:管理 Workers、R2 存储和 DNS,一句话就能部署边缘函数。

+ Grafana MCP:告别手动翻看几十个仪表盘,让 Claude 帮你监控指标、排查故障。

+ Railway / Render MCP:将“部署这个应用”变成一条简单的聊天指令。

生产力与业务操作

+ Notion MCP:官方出品。Claude 可以读写你的整个知识库,让文档管理自动化。

+ Slack MCP:总结团队讨论,或者让 Claude 替你发布项目进展。

+ Gmail MCP:搜索邮件、草拟回复,Claude 成了真正的沟通助理。

+ Jira / Asana MCP:打破产品经理和开发之间的信息壁垒,自动更新任务状态。

+ Stripe MCP:调试支付流程、检查订单状态,Claude 帮你盯着钱袋子。

+ HubSpot MCP:销售团队的神器,自动更新流水和客户信息。

网页抓取与数据提取

+ Firecrawl MCP:专门对付复杂网页,将混乱的 HTML 变成干净的 Markdown。

+ Browserbase MCP:云端浏览器,让 Claude 替你登录网站、填写表单。

+ Bright Data MCP:企业级数据采集,支持大规模并发抓取。

+ Apify MCP:调用 3000 多个现成的爬虫工具,不要自己写脚本,直接调用。

AI 增强与深度思考

+ Memory MCP:官方内存插件。让 Claude 跨会话记住你的偏好和事实,它会越来越懂你。

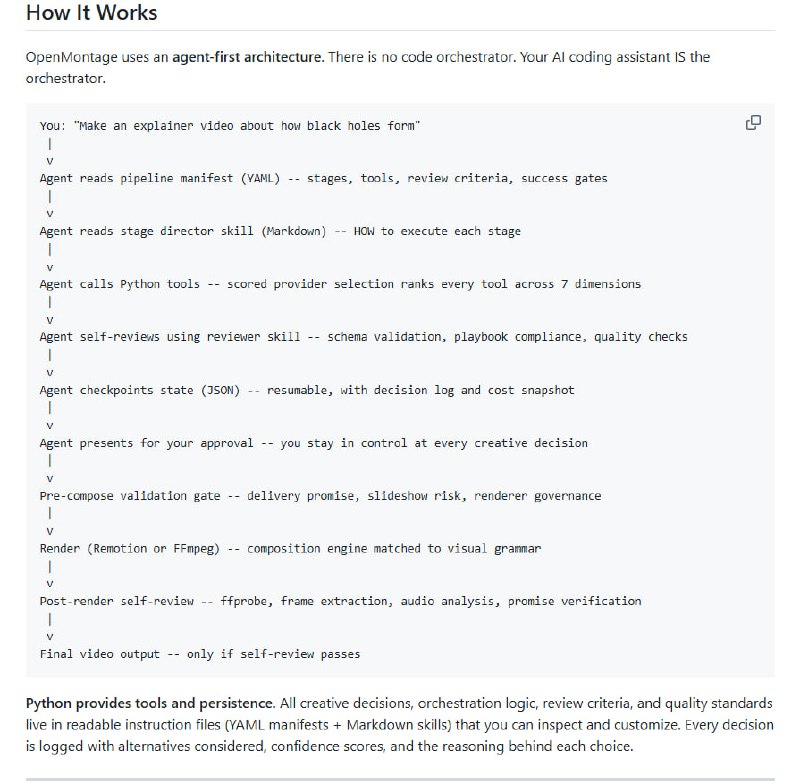

+ Sequential Thinking MCP:强制 Claude 进行结构化推理。这能显著降低它在处理复杂逻辑时的“幻觉”。

+ Context7 MCP:提供最新的文档支持。防止 Claude 使用过时的 API,让它永远参考最新版本。

媒体与设计

+ Figma MCP:设计转代码的桥梁。让 Claude 读样式、读组件规范,直接生成像素级还原的代码。

+ ElevenLabs MCP:让 Claude 拥有声音,自动生成播客、旁白或语音内容。

4. 进阶路径:如何科学地武装 Claude

不要一次性安装所有插件,这会干扰 Claude 的判断。建议遵循以下顺序:

第一步:安装基础(Foundation)。包括 Filesystem、Git、Memory 和 Sequential Thinking。

第二步:接入工具栈(Stack)。你用 GitHub 就装 GitHub,用 AWS 就装 AWS。

第三步:提升生产力(Productivity)。接入 Notion 和 Slack,让 Claude 进入你的沟通环。

第四步:按需扩展数据(Data)。需要抓取或大规模分析时,再开启 Firecrawl 等工具。