黑洞资源笔记

- 大厂前端工程师训练营 | 团购价299

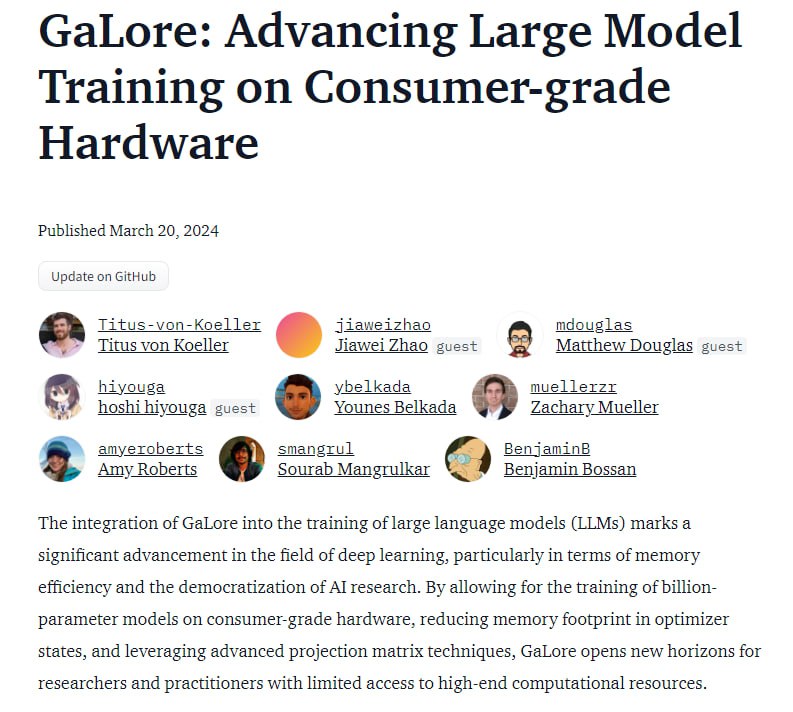

- 用GaLore在消费级硬件上训练大模型 | 原文

GaLore 是一种新的参数高效微调(Parameter Efficient Finetuning, PEFT)方法,可以在消费级GPU(如 RTX 3090)上高效训练大型语言模型。与其他PEFT方法(如LoRA、Prefix-Tuning等)相比,GaLore在保持性能的同时,显著降低了所需的内存和计算资源。

GaLore 的关键创新在于引入了一种新的参数分解方式,将模型参数分解为低秩和稀疏两部分,从而大幅减少需要微调的参数数量。GaLore使得在消费级GPU如RTX 4090上训练包含多达70亿参数的语言模型成为可能,这是通过显著减少优化器状态和梯度所需的内存实现的。

在 GPT-2 等基准测试中,GaLore 展现出与完整模型微调相当的性能,但仅需 1/10 的内存和计算资源。

GaLore 不仅适用于自然语言处理任务,对于计算机视觉等其他领域也具有广阔的应用前景。该技术有望推动大型模型的民主化,使更多个人研究者和小型机构能够在普通硬件上训练和部署这些模型。

点评:

GaLore 的提出打破了人们对大型模型训练必须依赖昂贵硬件的传统观念,这一反常规的创新值得关注。

将模型参数分解为低秩和稀疏两部分的思路具有很高的创新性和独创性,体现了作者对问题的深入思考。

如果 GaLore 的性能优势得到进一步验证,它有望彻底改变大型模型训练的范式,推动 AI 民主化进程。

尽管取得了突破性进展,但 GaLore 在实际应用中可能还面临一些挑战,如泛化性能、训练稳定性等,需要持续优化和改进。

该技术的出现也引发了一些值得深思的问题,比如大型模型的能源消耗、隐私和安全性等,需要引起足够重视。 - OpenAI的GPT商店充斥大量违规内容 | 原文

OpenAI 推出的 GPT 商店(GPT Store)旨在让开发者构建基于 OpenAI 生成式 AI 模型的定制聊天机器人,用于完成各种任务。

然而,该商店目前被大量奇怪的、可能侵犯版权的 GPT 机器人所淹没,这些机器人宣称能够生成迪士尼和漫威等知名 IP 的艺术作品,实际上只是将用户引导至第三方付费服务,并自称能够绕过 AI 内容检测工具。

这一现象暴露了 OpenAI 在审核和管理 GPT 商店内容方面的不足,存在着较为宽松的监管。一些 GPT 机器人还声称能够生成令人反感或不当的内容,如仇恨言论、暴力内容等,这进一步加剧了对 OpenAI 内容审核的质疑。

点评:

OpenAI 在推出 GPT 商店时,可能低估了管理和审核内容的难度,导致了目前的混乱局面。过于宽松的审核政策,不仅可能助长版权侵权行为,还有引导 AI 系统产生有害内容的风险。

这一事件再次凸显了 AI 系统在伦理和安全方面的挑战,需要制定更加严格的准则和监管措施。尽管 GPT 商店的初衷是推动 AI 创新,但如果缺乏有效管控,反而可能适得其反,损害 OpenAI 的声誉和公众对 AI 的信任。OpenAI 需要及时采取行动,加强内容审核,清理违规内容,并制定更加透明和负责任的管理机制,以确保 GPT 商店的健康发展。

这一事件也引发了人们对 AI 系统的担忧,如何在促进创新与维护秩序之间寻求平衡,是一个亟待解决的难题。 -

-

-

-

-

-

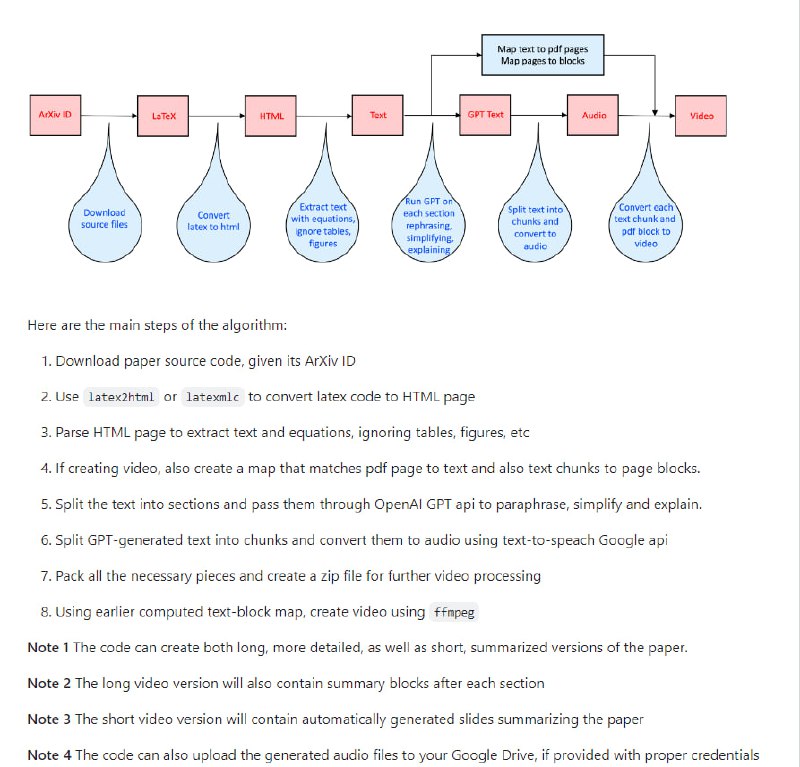

- ArXiv Paper Reader:旨在简化和流利的arXiv论文阅读,使用 LaTeX 代码转换为 HTML 页面,然后提取文本和公式,将其转换为视频,并创建与 PDF 文档匹配的图,以及文本分段并将其转换为音频