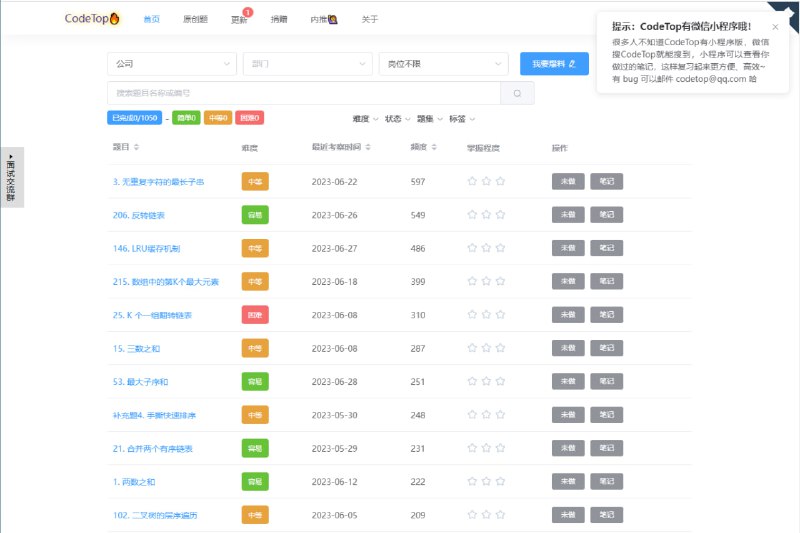

直观理解各种算法差异

黑洞资源笔记

-

- 开发者Julio Merino上传了一段视频引发广泛讨论。这是一台2000年的电脑,CPU 600MHz, 128MB RAM,机械硬盘,运行Windows NT 3.51系统。似乎流畅程度还要高于20多年后的很多计算机。他认为现代计算机界面、现代操作系统和现代应用程序的延迟非常糟糕,而且越来越严重。

-

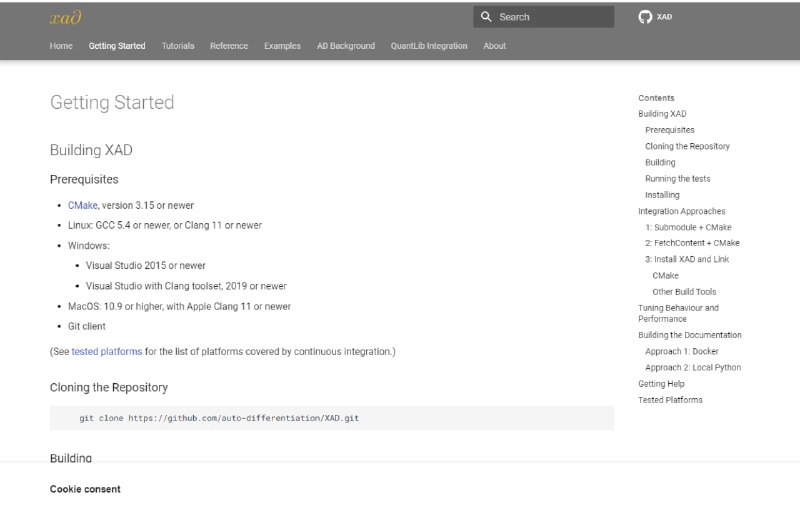

- XAD:全面的C++自动微分库,旨在为任意规模的生产代码提供易用性和高性能。

自动微分(也称为算法微分)是一组用于计算指定为计算机程序的函数的偏导数的技术。由于每个程序执行总是由一系列具有已知导数的简单运算(算术和数学函数,如 sin、exp、log 等)组成,因此可以重复应用链式法则来自动计算偏导数。XAD 在 C++ 中使用运算符重载来实现这一点,从而允许在对程序进行最小更改的情况下计算导数。有关更多详细信息,请参阅自动微分数学背景。

主要特征:

使用运算符重载的任何顺序的正向和伴随模式

检查点支持(用于磁带内存管理)

外部函数接口(集成外部库)

螺纹安全胶带

正式的异常安全保证

高性能

在大型生产代码库中经过实战测试 - BillaBear:独立的订阅管理和计费系统,能与Stripe集成,提供REST API,可以方便地进行集成

- 学术写作提示工程实战指南

这份写作提示列表涵盖了一系列主题和任务,包括集思广益的研究想法、改进语言和风格、进行文献综述以及制定研究计划。不管你是学生、研究人员还是学术专业人士,这些提示都能帮你磨练写作能力并很好地处理写作项目。该列表会定期更新,

ChatGPT Prompts for Academic Writing | #指南 -

-

- 一个名为Imagiscope Tech的公司开发了一个很酷的插件,该插件可将全球任何地方的Google Earth的3D数据导入到Blender中。用户只需设置位置,模型就会直接导入到场景中。然后你就可以在Blender中轻松调整。

这对于需要在真实环境中进行建模的项目(如城市规划、GIS分析、电影和游戏设计等)非常有用。

Earth Modeler插件是一个简单的面板插件,你只需要输入坐标(可以从Google Maps获取),然后点击开始按钮。插件会快速分析Google提供的数据,然后在Blender中创建一个优化的模型。这个过程可能需要5到15分钟。

Earth Modeler使用了一个径向细节算法,以增强围绕焦点的对象的细节。此外,还可以手动增强单个模型瓦片的细节。

插件允许你添加水面,只需要添加一个平面,然后调整它的位置,然后添加你喜欢的水材质。此外提供了一种新的着陆腿设计,通过拉动两个支杆并过度伸展底部的碳纤维支杆来锁定上部支杆。这种设计使火箭具有非常宽的基座,有助于防止倾倒。

你可以使用Matlab模拟来模拟火箭的稳定性和PID调整,以及找出点火降落马达的最佳时间。你可以设置相机,设置剪辑端到一百万米,这将为相机提供足够的深度来查看所有的建模。模型的真实世界比例是1:10,所以1米将等于10米的真实生活。

该插件的意义:

实地建模:Earth Modeler插件可以根据真实的地理数据创建3D模型,这对于需要在真实环境中进行建模的项目(如城市规划、地理信息系统(GIS)分析、电影和游戏设计等)非常有用。

提高效率:传统上,创建这种详细的3D模型需要大量的手动工作和时间。Earth Modeler插件可以自动创建模型,大大节省了时间和精力。

易于使用:Earth Modeler插件的操作非常简单,只需要输入坐标,然后点击开始按钮,插件就会自动创建模型。

灵活性:由于模型是在Blender中创建的,所以艺术家和设计师可以利用Blender的所有工具和功能来修改和优化模型。 -

-

-

-

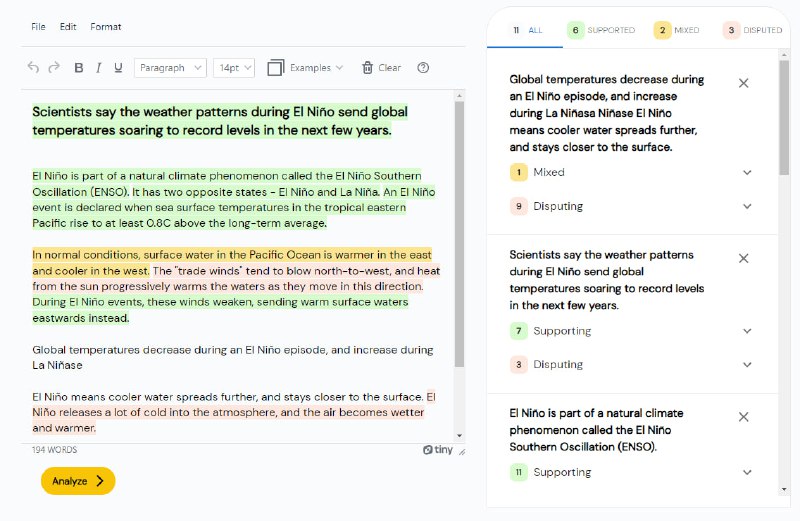

- 一个在线文本编辑器,可以帮助记者和媒体专业人员实时验证新闻的准确性,提高报道的可信度和可靠性,快速检测有偏见或误导性信息,从而促进细致而可靠的报道,还可以检测由人或聊天机器人(如ChatGPT)创建的任何文本中的错误、偏见、争议和虚假信息。

Factiverse | #编辑器 - ChatGLM2-6B 是开源中英双语对话模型 ChatGLM-6B 的第二代版本,在保留了初代模型对话流畅、部署门槛较低等众多优秀特性的基础之上,ChatGLM2-6B 引入了如下新特性:

更强大的性能:基于 ChatGLM 初代模型的开发经验,我们全面升级了 ChatGLM2-6B 的基座模型。ChatGLM2-6B 使用了 GLM 的混合目标函数,经过了 1.4T 中英标识符的预训练与人类偏好对齐训练,评测结果显示,相比于初代模型,ChatGLM2-6B 在 MMLU(+23%)、CEval(+33%)、GSM8K(+571%) 、BBH(+60%)等数据集上的性能取得了大幅度的提升,在同尺寸开源模型中具有较强的竞争力。

更长的上下文:基于 FlashAttention 技术,将基座模型的上下文长度(Context Length)由 ChatGLM-6B 的 2K 扩展到了 32K,并在对话阶段使用 8K 的上下文长度训练,允许更多轮次的对话。但当前版本的 ChatGLM2-6B 对单轮超长文档的理解能力有限,开发者会在后续迭代升级中着重进行优化。

更高效的推理:基于 Multi-Query Attention 技术,ChatGLM2-6B 有更高效的推理速度和更低的显存占用:在官方的模型实现下,推理速度相比初代提升了 42%,INT4 量化下,6G 显存支持的对话长度由 1K 提升到了 8K。

更开放的协议:ChatGLM2-6B 权重对学术研究完全开放,在获得官方的书面许可后,亦允许商业使用。