2026 AI 工程师面试核心:90% 考点都在这 12 个概念里 |

帖子站在2026年的门槛上,AI工程师的面试已经从最初的玄学回归到了工程本质。无论面试官如何发问,90%的核心考点都逃不出这12个概念的范畴。

这不仅是一份面试清单,更是构建生产级AI应用的技术地图。

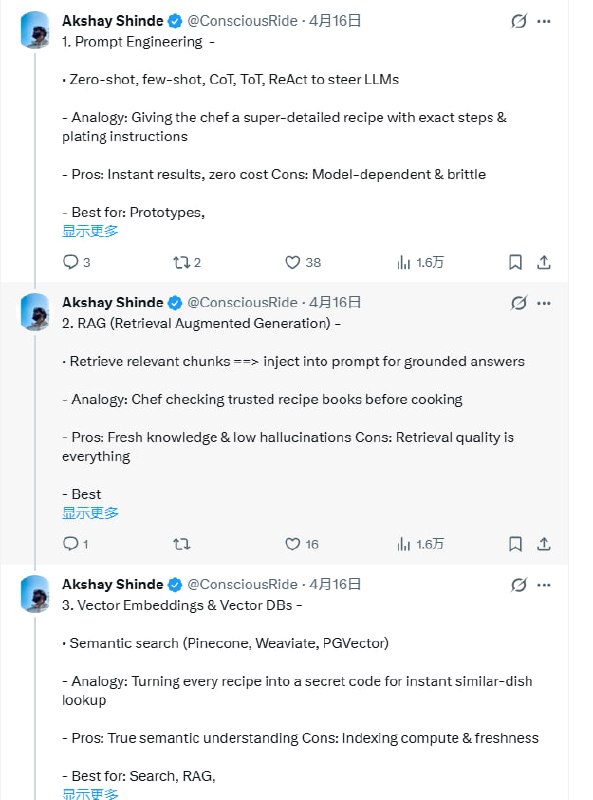

1. 提示工程 (Prompt Engineering)

这是与模型沟通的艺术。不仅是写几句话,而是通过Zero-shot、Few-shot、思维链(CoT)、思维树(ToT)以及ReAct框架来精准引导模型。

见解:提示词是最低成本的逻辑控制,但其脆弱性要求工程师必须具备模型无关的防御性编程思维。

2. 检索增强生成 (RAG)

让模型查字典后再说话。通过检索相关知识块并注入提示词,解决模型幻觉和知识滞后问题。

见解:RAG的本质是知识解耦,检索质量直接决定了生成的上限。

3. 向量嵌入与向量数据库 (Vector Embeddings & DBs)

语义搜索的基石。将非结构化数据转化为数学向量,实现真正的语义理解。

见解:选型Pinecone或PGVector只是开始,索引的更新频率和检索精度才是生产环境的痛点。

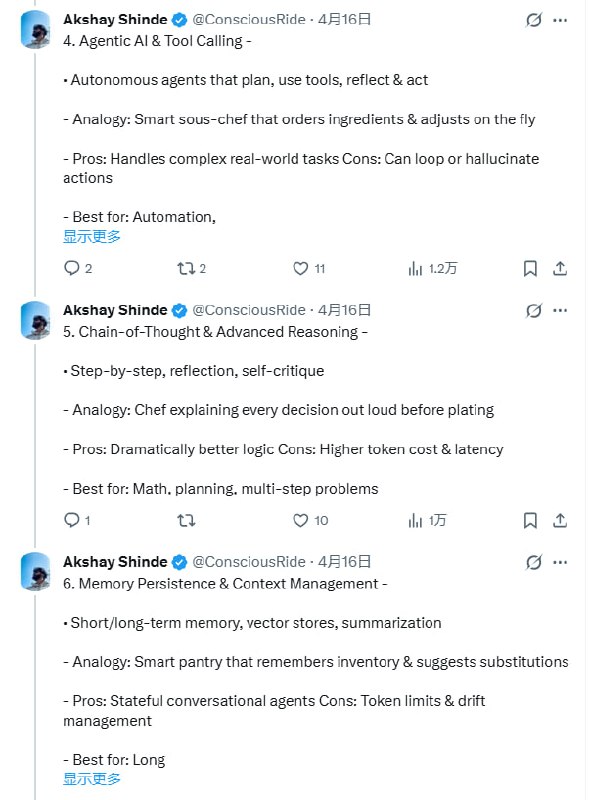

4. 智能体与工具调用 (Agentic AI & Tool Calling)

从对话框到行动派。让模型自主规划、调用外部API并进行自我反思。

见解:Agent是AI从“助理”向“员工”转变的关键,难点在于如何防止逻辑死循环和幻觉执行。

5. 深度推理与思维链 (CoT & Reasoning)

让模型“想清楚再开口”。通过步骤拆解、自我批判来提升逻辑复杂任务的表现。

见解:推理能力是有代价的,工程师需要在Token成本、响应延迟与逻辑正确性之间寻找平衡。

6. 记忆持久化与上下文管理 (Memory Management)

解决AI的“鱼类记忆”。利用向量存储和摘要技术,管理长短期记忆。

见解:上下文窗口再大也有极限,高效的上下文压缩和状态管理是长对话系统的核心。

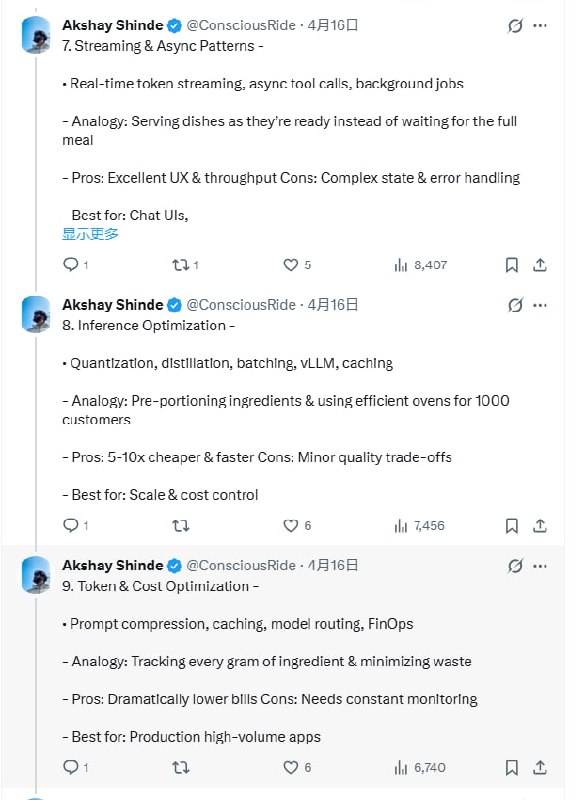

7. 流式传输与异步模式 (Streaming & Async)

优化用户体验的关键。实时推送Token,异步处理工具调用和后台任务。

见解:在AI时代,UX就是生产力。流式输出能极大缓解用户在等待复杂推理时的焦虑。

8. 推理优化 (Inference Optimization)

让AI跑得更快、更省。涉及量化、蒸馏、vLLM加速和缓存技术。

见解:模型训练是科学,模型推理是工程。5到10倍的成本缩减往往来自于这些底层的优化。

9. Token与成本管理 (FinOps)

每一行输出都是真金白银。通过提示词压缩、模型路由和精细化监控来控制账单。

见解:不能为公司省钱的AI工程师不是好的架构师。

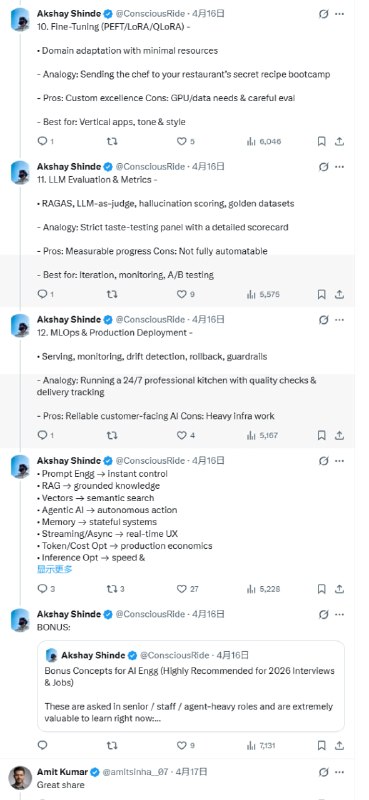

10. 微调技术 (Fine-Tuning/PEFT)

领域专家的养成。利用LoRA、QLoRA等轻量化技术,在有限资源下实现模型风格和知识的定制。

见解:微调不是为了灌输知识,而是为了对齐领域内的表达风格和任务规范。

11. 评估与度量 (LLM Eval)

告别“体感评估”。使用RAGAS、LLM-as-judge以及黄金数据集进行量化评分。

见解:没有度量就没有进步。自动化评估流程是CI/CD在AI时代的延伸。

12. MLOps与生产部署

从Demo到服务。涵盖监控、漂移检测、护栏机制(Guardrails)和回滚策略。

见解:AI应用的稳定性不取决于模型本身,而取决于支撑它的工程基础设施。

虽然这12个概念定义了AI工程师的专业深度,但面试的第一关往往依然是扎实的编程功底。Python数据结构、算法以及系统设计是进入这些高级讨论的入场券。

提示工程提供即时控制,RAG注入可靠知识,向量实现语义搜索,Agent赋予行动能力,而MLOps则保证这一切在生产环境中稳定运行。