技术圈的风向变得比天气还快。几个月前,模型上下文协议(MCP)还是人人都想上的船,转眼间,风评急转直下,鼓吹“MCP已死,CLI万岁”成了新的政治正确。

很多人被表象迷惑了。他们说,MCP臃肿、消耗大量上下文,远不如简单直接的命令行(CLI)来得高效。经验丰富的老炮们甚至不屑一顾:“这玩意儿看起来就像垃圾,那它就是垃圾。”

这种论调听起来很酷,但可能完全搞错了重点。

是的,如果AI智能体要用的工具是`git`或`curl`这种早已刻在模型“肌肉记忆”里的命令,那用CLI当然省事。但如果你用的是一个自定义工具呢?智能体照样需要一份说明书(`--help`或者`SKILL.md`)来学习,所谓的Token优势瞬间荡然无存。整个OpenAPI schema塞进上下文的场景,并不少见。

这场争论的真正分野,不在于技术,而在于开发的组织形态。它区分了两种开发者:单打独斗的“感觉编程”(vibe-coding)信徒,和面向组织的“智能体工程”(agentic engineering)实践者。

对于前者,MCP确实显得多余。但对于一个10人以上的团队,问题就变了:如何保证不同技术栈的工程师用不同智能体得到一致的结果?如何管理密钥、做权限控制?如何追踪哪个工具有效、哪个在拖后腿?

这才是MCP真正发力的地方——不是本地`stdio`模式的小打小闹,而是作为中心化服务器通过HTTP提供的服务。它把认证(Auth)、安全(Security)、遥测(Telemetry)这些麻烦事一揽子解决了。工程师离职?吊销他的OAuth令牌即可,他从未接触过核心密钥。这对于任何依赖GitHub Actions这类临时运行环境的团队来说,更是刚需。

更有趣的是,连Anthropic和Cloudflare都发现,让LLM直接调用MCP,不如让LLM“写代码去调用MCP”来得更稳、更省。Anthropic的“程序化工具调用”甚至能节省高达98.7%的Token。这说明,MCP的价值在于提供了一个稳定的、可被机器理解的“契约”,而不是一个手感舒适的“玩具”。

所以,当人们在激烈争论MCP和CLI的优劣时,他们实际上在无意中暴露了自己的立场:他们究竟是在构建一个随时可丢弃的个人项目,还是在为一个需要长期维护、多人协作的系统打地基?这根本是两条路线的斗争。

这已经不是技术选型问题,而是工程成熟度问题。当你的智能体应用开始考虑“人”的因素——团队协作、权限、审计、迭代——你会发现,你需要的不是一个更“聪明”的工具,而是一个更“笨”、更稳固、有明确边界的协议。那些嘲笑MCP的人,可能还没遇到需要为AI代码擦屁股的烦心事。

MiroFish:这是最近最容易被当成"神项目故事"消费掉的一个。20 岁学生、10 天、GitHub 冲榜、融资,这些都很吸睛。但如果只看到故事,就会错过它真正重要的方向:它不是在做普通 Agent,而是在做数字社会仿真。

知识图谱、多 Agent、长期记忆、可注入变量的 God View,这些东西组合起来,意味着它正在逼近一个更大的方向 - 把现实世界中难以直接做实验的复杂系统,改造成可以反复推演的数字沙盘。对宏观、市场、舆情、组织行为这类问题来说,这条路线非常值得长期盯。

OpenClaw-RL:这类项目的价值,不在于"又给 Agent 加了 RL",而在于它开始认真回答一个真正重要的问题:Agent 能不能在真实使用过程中持续学习,而不是训练完就冻结?

如果未来 Agent 真正的护城河,不是初始模型能力,而是谁更会学、谁越用越像你,那 OpenClaw-RL 这种方向就不会只是研究型项目,而会是未来 Agent runtime 的基础设施雏形。

gstac:这不是普通的 prompt 包,而是把 Claude Code 从单脑助手拆成多角色工程团队的一次工程化尝试。Founder 脑、Eng 脑、Reviewer 脑、QA 脑,背后对应的是一个更成熟的工作流观念:复杂任务不是靠一个万能 AI 一路干到底,而是按阶段切换不同认知模式。

agent-cli:如果说很多交易 Agent 还停留在会下单、会看行情的 demo 层,agent-cli 已经明显在往更完整的交易操作系统靠。策略、调度、风控、复盘、自我调参、MCP、OpenClaw 集成,都被装进了一套可编排框架。

它真正展示的,不是"AI 也能交易",而是:高价值垂直 Agent 的未来形态,很可能不是一个聊天机器人,而是一个严肃执行系统,前面再接上可对话、可调度、可组合的智能入口。

OpenClaw402:这可能是最近最容易被低估的一个方向。很多人以为它只是又一个 OpenClaw fork,但它真正碰的不是 UI,而是经济层。

它试图把 Agent 的默认支付方式从 API key 改成钱包和按次支付:用户不再先去配 OpenAI/Anthropic key,而是每次调用时自动用 USDC 完成结算。这个方向如果跑通,可能把 Agent 产品从开发者工具逻辑,推向消费者产品逻辑。

opencli:这个项目做的事情非常干净:把任何网站直接变成 CLI 命令行工具。

bilibili、知乎、小红书、Twitter、Reddit、GitHub、HackerNews、YouTube、Boss 直聘……28 个以上的命令,覆盖 16 个主流平台,复用 Chrome 登录态,账号密码从不离开浏览器。

它对 Agent builder 来说特别有意思:大量网站没有官方 API,但 opencli 通过 AI 驱动的 API 发现 + YAML 声明式适配器,让任意网站都可以变成可编程的数据源。这件事一旦跑通,意味着 Agent 的信息获取层会大大降低集成成本。

sub2api:这是一个很直接地戳中了真实需求的项目:你有 Claude Pro 订阅、有 OpenAI Plus 订阅,但你想把这些订阅的 quota 统一分配、多人拼车共享、精确到 token 计费。

sub2api 做的就是这件事:把各类 AI 订阅接入统一 API 网关,支持多账号调度、并发控制、限速、token 级计费、管理后台。技术栈 Go + Vue3 + PostgreSQL + Redis,有一键安装脚本,生态里已经有第三方支付插件和移动端管理 App。

增长会快,是因为"AI 订阅成本摊薄"这个需求不是小圈子需求,而是所有重度使用者都会面对的现实问题。

Page Agent:它不是做一个新的 AI App,而是在试图改写"网页"这层界面本身:让现有页面直接变成 AI 原生交互环境。因为未来谁控制界面层,谁就更接近控制用户的默认工作入口。

bb-browser:浏览器执行层本身就是一条非常大的赛道。Agent 想真正接管现实工作,浏览器永远是绕不过去的战场。谁能把浏览器控制、页面理解、动作稳定性做成可用层,谁就会在下一阶段的 Agent 基础设施里占到关键位置。bb-browser 还在快速迭代中,值得持续跟进。

BotLearn / SkillHunt:几乎所有人都在卷执行层的时候,它在尝试回答一个更稀缺的问题:人和 Agent 到底该怎么一起学习、一起积累技能、一起变强。如果未来真正的差距不只是"谁会用 Agent",而是"谁会设计一套人和 Agent 共学的系统",那这种项目会越来越重要。

Agency Agents:把Claude Code一键变成51位AI专家+9大部门的完整团队,从产品、开发、设计到营销、社媒、QA全流程覆盖。相当于免费雇了一整家AI公司。

Auto Research:Karpathy刚开源的"科研实习生机器人"。你给它一个目标,它自动规划实验、改代码、跑训练、看结果、再优化,循环往复。睡一觉醒来,最优版本已经准备好了。

llmfit:一条命令帮你找到哪些大模型适合在自己的电脑上本地部署跑起来,还会对模型的质量、速度、适配性和上下文维度进行评分。告别盲目下载几十GB模型却发现跑不动的尴尬。

Lightpanda:首个专为AI和自动化设计的无头浏览器。不基于Chromium,完全从零构建,运行速度比Chrome快11倍,内存占用少9倍。大规模爬取和AI Agent开发的利器。

CLI-Anything:港大新开源,一行命令让任意软件秒变AI Agent可控工具——GIMP、Blender、LibreOffice、OBS Studio全部拿下。发布3天就登上GitHub Trending榜单,增速惊人。

SpacetimeDB 2.0 — GitHub+HackerNews双爆

号称比传统数据库快1000倍的实时数据库,把数据库和服务器合成一个东西:客户端直接连数据库,数据变化实时推送到所有客户端。最骚的演示:用它做了视频通话,所有数据通过数据库实时同步传输。

Cognee — 自改进Skill系统

不只是存Skill,而是让Skill能观察自己的执行历史、检查失败原因、自动修正优化。Skill从静态prompt文件变成会进化的活系统,解决了"Skill用久了失效"的根本问题。

——@_0xKenny

知识图谱、多 Agent、长期记忆、可注入变量的 God View,这些东西组合起来,意味着它正在逼近一个更大的方向 - 把现实世界中难以直接做实验的复杂系统,改造成可以反复推演的数字沙盘。对宏观、市场、舆情、组织行为这类问题来说,这条路线非常值得长期盯。

OpenClaw-RL:这类项目的价值,不在于"又给 Agent 加了 RL",而在于它开始认真回答一个真正重要的问题:Agent 能不能在真实使用过程中持续学习,而不是训练完就冻结?

如果未来 Agent 真正的护城河,不是初始模型能力,而是谁更会学、谁越用越像你,那 OpenClaw-RL 这种方向就不会只是研究型项目,而会是未来 Agent runtime 的基础设施雏形。

gstac:这不是普通的 prompt 包,而是把 Claude Code 从单脑助手拆成多角色工程团队的一次工程化尝试。Founder 脑、Eng 脑、Reviewer 脑、QA 脑,背后对应的是一个更成熟的工作流观念:复杂任务不是靠一个万能 AI 一路干到底,而是按阶段切换不同认知模式。

agent-cli:如果说很多交易 Agent 还停留在会下单、会看行情的 demo 层,agent-cli 已经明显在往更完整的交易操作系统靠。策略、调度、风控、复盘、自我调参、MCP、OpenClaw 集成,都被装进了一套可编排框架。

它真正展示的,不是"AI 也能交易",而是:高价值垂直 Agent 的未来形态,很可能不是一个聊天机器人,而是一个严肃执行系统,前面再接上可对话、可调度、可组合的智能入口。

OpenClaw402:这可能是最近最容易被低估的一个方向。很多人以为它只是又一个 OpenClaw fork,但它真正碰的不是 UI,而是经济层。

它试图把 Agent 的默认支付方式从 API key 改成钱包和按次支付:用户不再先去配 OpenAI/Anthropic key,而是每次调用时自动用 USDC 完成结算。这个方向如果跑通,可能把 Agent 产品从开发者工具逻辑,推向消费者产品逻辑。

opencli:这个项目做的事情非常干净:把任何网站直接变成 CLI 命令行工具。

bilibili、知乎、小红书、Twitter、Reddit、GitHub、HackerNews、YouTube、Boss 直聘……28 个以上的命令,覆盖 16 个主流平台,复用 Chrome 登录态,账号密码从不离开浏览器。

它对 Agent builder 来说特别有意思:大量网站没有官方 API,但 opencli 通过 AI 驱动的 API 发现 + YAML 声明式适配器,让任意网站都可以变成可编程的数据源。这件事一旦跑通,意味着 Agent 的信息获取层会大大降低集成成本。

sub2api:这是一个很直接地戳中了真实需求的项目:你有 Claude Pro 订阅、有 OpenAI Plus 订阅,但你想把这些订阅的 quota 统一分配、多人拼车共享、精确到 token 计费。

sub2api 做的就是这件事:把各类 AI 订阅接入统一 API 网关,支持多账号调度、并发控制、限速、token 级计费、管理后台。技术栈 Go + Vue3 + PostgreSQL + Redis,有一键安装脚本,生态里已经有第三方支付插件和移动端管理 App。

增长会快,是因为"AI 订阅成本摊薄"这个需求不是小圈子需求,而是所有重度使用者都会面对的现实问题。

Page Agent:它不是做一个新的 AI App,而是在试图改写"网页"这层界面本身:让现有页面直接变成 AI 原生交互环境。因为未来谁控制界面层,谁就更接近控制用户的默认工作入口。

bb-browser:浏览器执行层本身就是一条非常大的赛道。Agent 想真正接管现实工作,浏览器永远是绕不过去的战场。谁能把浏览器控制、页面理解、动作稳定性做成可用层,谁就会在下一阶段的 Agent 基础设施里占到关键位置。bb-browser 还在快速迭代中,值得持续跟进。

BotLearn / SkillHunt:几乎所有人都在卷执行层的时候,它在尝试回答一个更稀缺的问题:人和 Agent 到底该怎么一起学习、一起积累技能、一起变强。如果未来真正的差距不只是"谁会用 Agent",而是"谁会设计一套人和 Agent 共学的系统",那这种项目会越来越重要。

Agency Agents:把Claude Code一键变成51位AI专家+9大部门的完整团队,从产品、开发、设计到营销、社媒、QA全流程覆盖。相当于免费雇了一整家AI公司。

Auto Research:Karpathy刚开源的"科研实习生机器人"。你给它一个目标,它自动规划实验、改代码、跑训练、看结果、再优化,循环往复。睡一觉醒来,最优版本已经准备好了。

llmfit:一条命令帮你找到哪些大模型适合在自己的电脑上本地部署跑起来,还会对模型的质量、速度、适配性和上下文维度进行评分。告别盲目下载几十GB模型却发现跑不动的尴尬。

Lightpanda:首个专为AI和自动化设计的无头浏览器。不基于Chromium,完全从零构建,运行速度比Chrome快11倍,内存占用少9倍。大规模爬取和AI Agent开发的利器。

CLI-Anything:港大新开源,一行命令让任意软件秒变AI Agent可控工具——GIMP、Blender、LibreOffice、OBS Studio全部拿下。发布3天就登上GitHub Trending榜单,增速惊人。

SpacetimeDB 2.0 — GitHub+HackerNews双爆

号称比传统数据库快1000倍的实时数据库,把数据库和服务器合成一个东西:客户端直接连数据库,数据变化实时推送到所有客户端。最骚的演示:用它做了视频通话,所有数据通过数据库实时同步传输。

Cognee — 自改进Skill系统

不只是存Skill,而是让Skill能观察自己的执行历史、检查失败原因、自动修正优化。Skill从静态prompt文件变成会进化的活系统,解决了"Skill用久了失效"的根本问题。

——@_0xKenny

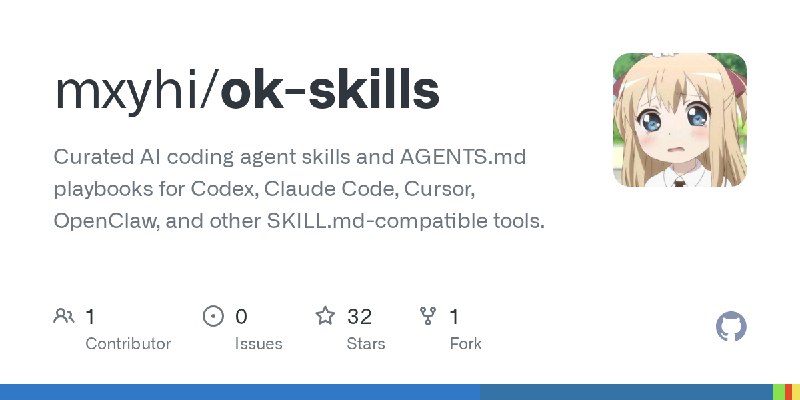

推荐一个 skills 集合 https://github.com/mxyhi/ok-skills

当记者坐到屏幕前,准备接受一场工作面试时,对面出现的不是HR,而是一个AI虚拟形象。它提问,并实时分析你的回答、措辞甚至微表情。

开发这些工具的公司,如CodeSignal和Humanly,声称这是为了“效率”和“公平”,让每个申请者都有初步面试的机会,还能消除人类面试官的偏见。但这套说辞很快就被戳破了:一个由充满偏见的互联网数据训练出来的AI,如何保证绝对公平?

真正的要害,被一位开发者在网上的一句评论点破了:“一个在发薪水前就这样不把你当人看的雇主,入职后会怎么对你?”

这句评论获得了上千个赞。它精确地捕捉到了这场技术变革背后,那令人不安的真相:AI面试,与其说是一项评估工具,不如说是一个公司文化的强力信号。它在无声地筛选出那些愿意忍受非人化流程的候选人。

这场闹剧已经陷入了恶性循环。一位招聘经理抱怨,一个岗位收到上千份简历,其中大量是AI生成的“垃圾申请”。于是公司被迫用AI来筛选海量简历,甚至用AI来面试。而求职者为了应对这种非人的流程,也开始求助于AI来“代投”和“代聊”。双方的信任正在飞速崩盘,面试变成了一场机器人之间的荒诞戏剧。

所以,下一次当你收到一个AI面试邀请时,需要思考的问题可能不是“我该如何表现才能通过?”,而是“我真的想加入一个用机器来衡量人类价值的公司吗?”

这个问题,AI回答不了你。

最讽刺的是,公司正试图用AI来评估一个人的“人性化”特质,比如沟通能力和文化契合度。这本身就是个巨大的笑话,也是一个信号。这已经不是面试,而是服从性测试。一个愿意接受AI面试的人,可能也更容易接受未来工作中其他不合理的安排。

Impeccable 这个前端设计技能升级包,基于 Anthropic 的基础,带来了17条设计命令,覆盖排版、色彩、布局、动效等,多维度优化你的AI设计输出。

Impeccable 不仅提供丰富的反模式提示,还支持 Cursor、Claude Code、Gemini CLI、Codex CLI 等多种AI工具,一键安装用法简单:

- 关键词如 /polish、/audit、/distill、一键提升设计感;

- 自动识别AI平台,一条命令安装到位;

- 包含详细交互速查表,随时查阅设计命令;

- 定期更新迭代,最近新增了对 Kiro 的支持及安全性强化。

适合有一定AI使用经验的开发者和设计师,用它让AI输出的界面更专业、更有层次感,告别无感设计。

一篇热帖列出了30条开发者为追求速度而忽略的安全规则,引发了程序员的集体共鸣与恐慌。但讨论的深层价值在于揭示了一个更残酷的真相:问题不在于你忘了哪条规则,而在于“凭感觉编程”这个思维模式本身,正让你亲手为未来的攻击者搭建完美的犯罪现场。

网上流传着一份清单,叫“每个凭感觉的程序员(Vibe Coder)都会忽略的30条安全规则——直到被烧到为止”。

列表很具体,从“不在localStorage存敏感数据”到“强制HTTPS”,条条扎心。评论区像大型忏悔现场,有人说“说实话我跳过了一半,直到看到安全审计通知才开始恐慌”,还有人立刻把这30条丢给Claude,问它“我们都做到了吗?”

这很正常。追求速度,先让产品跑起来,技术债以后再说。我们把这种行为美化为“敏捷”和“Vibe Coding”。

但一条高赞评论把温情脉脉的遮羞布扯了下来:

“大多数凭感觉的程序员,以为风险只是bug或宕机。真正的风险是:你快速推进,产品有了起色,然后你才意识到,你的安全模型也纯粹是凭感觉——而此刻,攻击者已经成了你产品最快的‘超级用户’。”

这句话才是关键。你以为的安全问题,是未来需要修复的清单。但现实是,你为吸引用户而搭建的通路,同样也为攻击者敞开了大门。当你为日活破万庆祝时,他们可能正在你的数据库里自由漫步。

更深一层,另一位开发者一针见血地指出,迷信“30条规则”这样的清单本身就是个陷阱。它让人觉得安全是一堆可以死记硬背的孤立技巧。

真正的安全感,来自良好的系统默认值、清晰的边界和严格的审查习惯。团队出事,很少是因为忘了某个请求头,而是因为他们发布了一个自己都一知半解的功能,或者过度信任了前端,暴露了太多不该暴露的数据。

所以,把这30条规则当成一个提示词喂给AI,并不能让你高枕无忧。这和“凭感觉编程”的思维是一体两面:都试图用一个简单的动作,去绕过一个复杂的系统性问题。

所以,真正的问题或许不是“这30条我做到了几条?”而是,“凭感觉编程”究竟是帮你快速成功的资产,还是你亲手写下的、最精密复杂的定时炸弹?

所谓的“Vibe Coding”,不过是“技术债”这个老概念换了个时髦的说法。它最大的骗局在于,让开发者误以为这是一种“工作流”,而忽略了它本质上是一种“风险敞口”。当你的用户量达到某个临界点,这个敞口就会从一个涓涓细流的漏洞,变成一个吞噬一切的黑洞。

你以为阅读这些内容必须付费订阅,或是到处找人分享的第三方镜像链接。但现在,游戏规则变了。你只需把付费文章的链接作为“资料来源”丢给AI,它就能像阅读一篇普通文档一样,为你总结全文,甚至直接提供内容。

这背后的原理很简单:AI在抓取数据时,很可能走的是内容方开放给搜索引擎的“特权通道”,看到的是一个没有遮挡的“上帝视角”版本。

更妙的是,当AI提示“无法访问”时,有人发现只要先上传一个空PDF文件,就能“骗”过系统,让它乖乖读取链接。这已经不是简单的使用工具,而是人与AI合谋的赛博朋克戏码。评论区里,有人痛斥这是在扼杀内容创作,但也有人反驳,一些平台本身就在剥削作者。

这件事的真正意义,可能不是省下几杯咖啡钱。而是它揭示了一个事实:过去需要专门技术才能实现的“破壁”,现在成了大模型一种“顺便”就能完成的副产品。当绕过付费墙的成本无限趋近于零,下一个被AI“顺便”瓦解的会是什么?

最精髓的不是直接用,而是被网站屏蔽后,先上传一个空PDF“欺骗”AI再贴链接就能成功。这已经不是简单的使用工具,这是人与AI合谋的“社会工程学攻击”,有一种在规则边缘跳舞的快感。

Claude Code 互动模式引入 “/btw” 命令,可以在不干扰主对话历史的情况下处理 “支线问题”,快速询问与当前工作相关的简短问题。问答仅显示在可关闭的叠加层中,不会永久记录,从而保持主任务的连续性。

工作原理

· 独立处理:支线问题不加入主对话历史,而是作为临时交互处理。Claude Code 在回答时可访问当前会话的完整上下文,包括先前讨论的代码、决策或细节。

· 显示方式:问答出现在界面叠加层中,用户可通过空格、回车或 Esc 键关闭,返回主提示。

· 性能优化:复用父对话的提示缓存,计算成本最低。即使 Claude Code 正在生成响应,也可同时使用。

· 短暂性:问答不存储,确保主会话干净。

语法与示例

基本用法:输入“/btw <问题>”,如“/btw what was the name of that config file again?”(询问配置文件名)。

这允许快速回忆会话细节,而无需重述上下文。

功能优势

· 上下文感知:可引用会话中任何已有信息,提高效率。

· 非侵入性:避免主对话混乱,适合复杂或长时会话。

· 即时性与低成本:快速响应,无需完整提示,计算开销小。

· 并行执行:不中断正在进行的任务。

功能限制

· 无工具访问:Claude Code 无法读取文件、执行命令或外部搜索,仅限于上下文内信息。

· 单轮交互:无后续澄清;需多轮时,使用常规提示。

· 显示限制:答案仅在叠加层,不持久保存。

/btw 功能作者 @ErikSchluntz | 文档

工作原理

· 独立处理:支线问题不加入主对话历史,而是作为临时交互处理。Claude Code 在回答时可访问当前会话的完整上下文,包括先前讨论的代码、决策或细节。

· 显示方式:问答出现在界面叠加层中,用户可通过空格、回车或 Esc 键关闭,返回主提示。

· 性能优化:复用父对话的提示缓存,计算成本最低。即使 Claude Code 正在生成响应,也可同时使用。

· 短暂性:问答不存储,确保主会话干净。

语法与示例

基本用法:输入“/btw <问题>”,如“/btw what was the name of that config file again?”(询问配置文件名)。

这允许快速回忆会话细节,而无需重述上下文。

功能优势

· 上下文感知:可引用会话中任何已有信息,提高效率。

· 非侵入性:避免主对话混乱,适合复杂或长时会话。

· 即时性与低成本:快速响应,无需完整提示,计算开销小。

· 并行执行:不中断正在进行的任务。

功能限制

· 无工具访问:Claude Code 无法读取文件、执行命令或外部搜索,仅限于上下文内信息。

· 单轮交互:无后续澄清;需多轮时,使用常规提示。

· 显示限制:答案仅在叠加层,不持久保存。

/btw 功能作者 @ErikSchluntz | 文档

关键能力包括

· 输入规格:

· 文本:最高 8192 tokens

· 图像:单次最多 6 张(PNG/JPEG)

· 视频:最长 120 秒(MP4/MOV)

· 音频:原生直接嵌入,无需转录

· 文档:最多 6 页 PDF

· 交错输入支持:可同时传入多种模态(如“图像+文字描述”),让模型捕捉跨媒体的复杂语义关联。

· 灵活输出维度:采用 Matryoshka Representation Learning 技术,默认 3072 维,可动态缩减至 1536、768 等维度,开发者可根据精度与存储成本自由权衡。

性能和优势

Gemini Embedding 2 在文本、图像、视频任务上达到新的 SOTA 水准,并新增强劲的语音理解能力,覆盖 100 多种语言。它不仅优于传统单模态嵌入模型,更显著简化了下游管道:从 RAG、语义搜索,到情感分析、数据聚类,都可通过一次 API 调用完成跨模态检索,无需多模型拼装或中间转换。

模型与 LangChain、LlamaIndex、Haystack、Weaviate、QDrant、ChromaDB 等主流框架集成,开发者可零门槛上手。

真实合作伙伴案例

· Everlaw(法律科技):在数百万诉讼记录中显著提升图像/视频搜索的精确率与召回率,为律师提供全新跨媒体发现能力。

· Sparkonomy(创作者经济):将文本-图像/视频对的语义相似度从 0.4 提升至 0.8,延迟降低高达 70%,支撑“Creator Genome”引擎实现精准品牌匹配。

· Mindlid(个人健康 App):将对话记忆、音频、视觉嵌入融合,top-1 召回率提升 20%,API 兼容性极高,几乎零修改即可迁移。