黑洞资源笔记

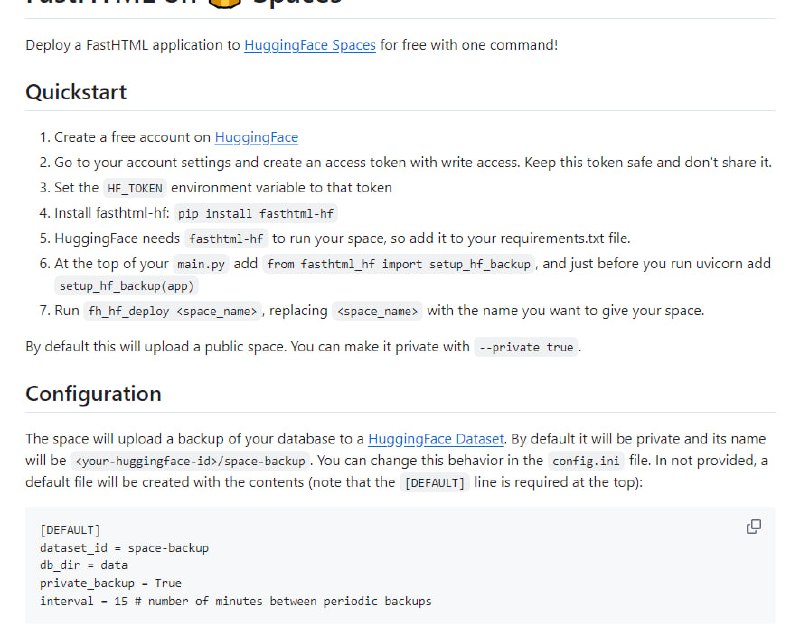

- FastHTML on Spaces:一键部署FastHTML应用至HuggingFace Spaces,支持免费部署,自动备份数据库至HuggingFace Dataset,提供公有与私有空间选项

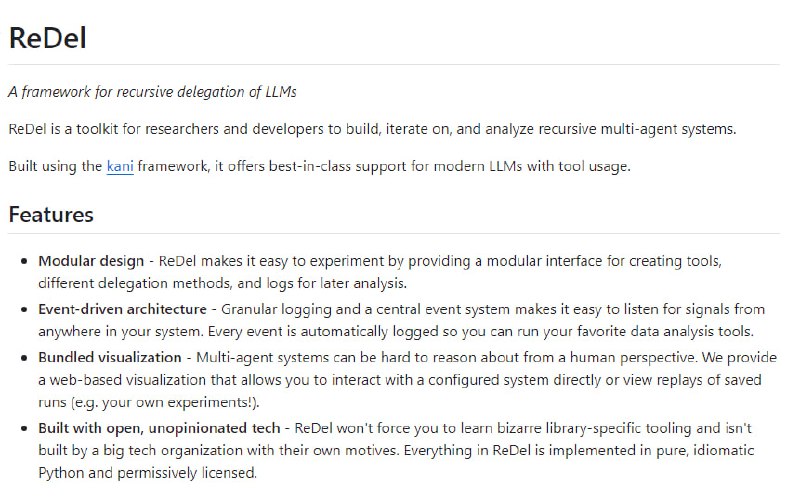

- ReDel:为研究人员和开发者构建、迭代和分析递归多智能体系统的套件,提供模块化设计、事件驱动架构和内置可视化工具,支持现代大型语言模型和工具使用

-

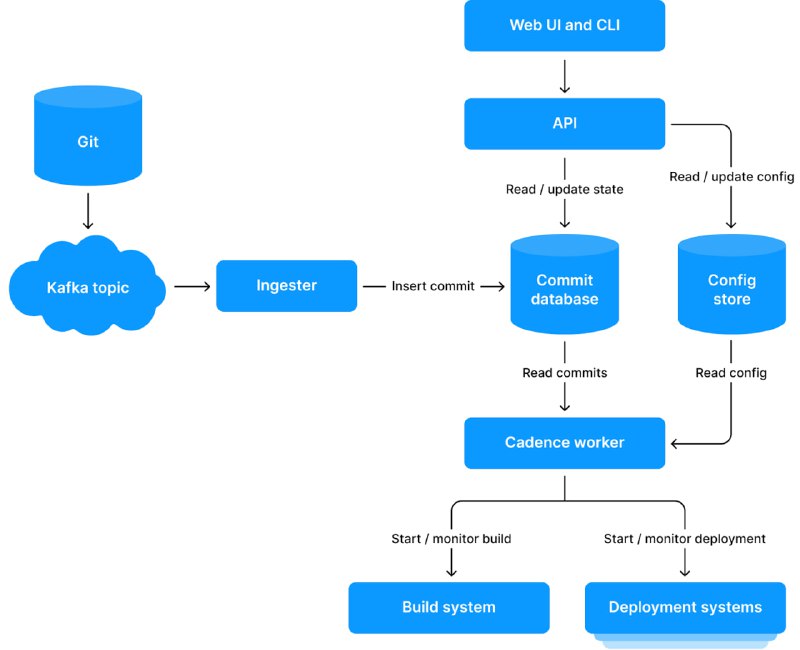

- Uber新发了一篇技术博客,介绍了他们如何重构微服务的持续部署,以提高部署自动化和微服务管理的用户体验。| blog

Uber的业务依赖于众多微服务,这些服务的持续部署对于确保新功能、库更新和安全补丁能够及时、安全地交付至生产环境至关重要。文章分享了Uber如何重构微服务的持续部署,以提高部署自动化和微服务管理的用户体验,同时解决了大型单一仓库(monorepo)中不断增长的提交量所带来的挑战。 -

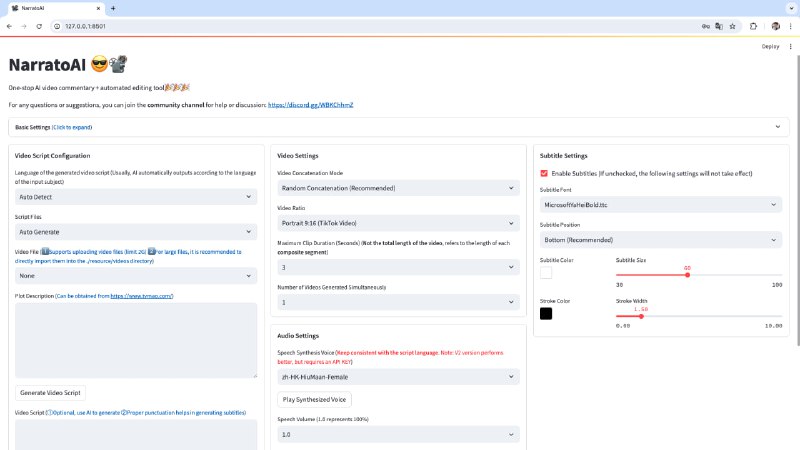

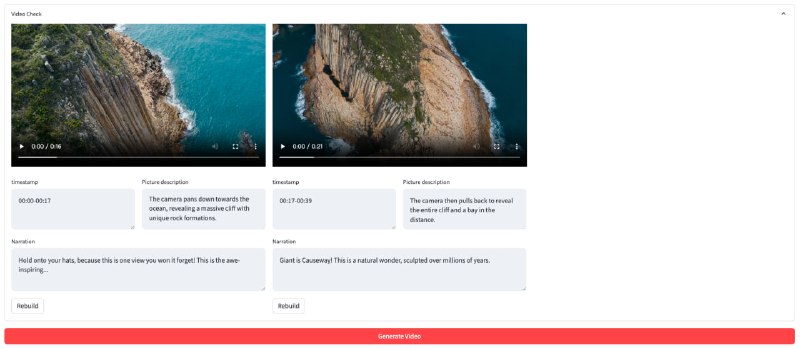

- 一款全自动视频翻译的 AI 工具:VideoLingo | #工具

能够一键全自动对视频进行字幕切割、翻译、精准对齐和个性化配音,最终生成 Netifx 级别的字幕和配音。

具有如下特点:

- 使用 NLP 和 LLM 进行字幕分割;

- 智能术语知识库,实现上下文感知翻译;

- 三步翻译过程:直接翻译 - 反思 - 改进;

- 精确的单词级字幕对齐;

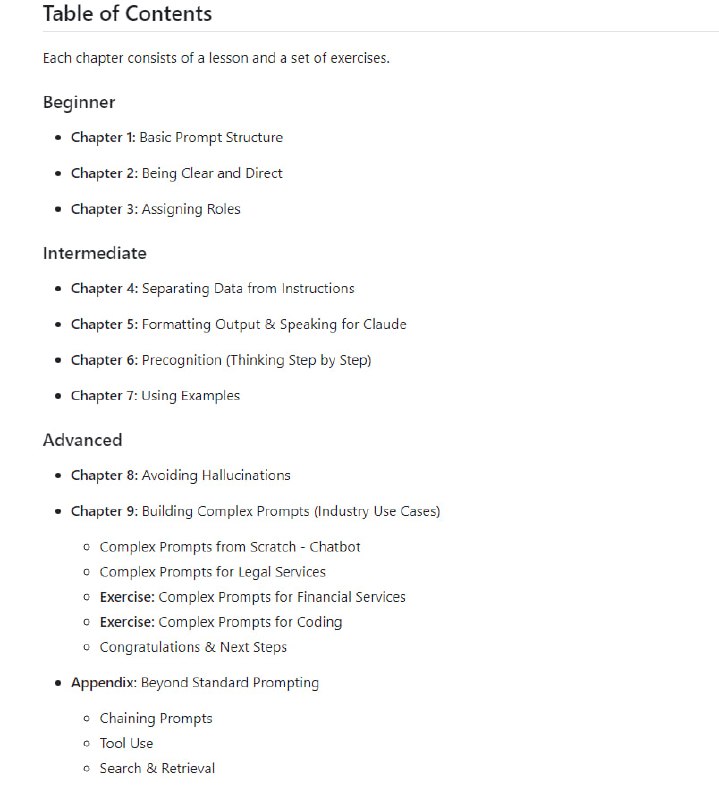

- 使用 GPT-SoVits 克隆音色并生成高质量的配音。 - Anthropic提示工程交互式教程:深入理解如何在Claude中构建最优提示的全面步骤指南,帮助用户掌握构建有效提示的基本结构,识别常见失败模式,并利用'80/20'技巧进行应对,理解Claude的优势和局限,从头开始构建针对常见用例的强大提示

Prompt Engineering Interactive Tutorial | #指南 -

-

- Liger-Kernel:为大型语言模型训练设计的高效 Triton 内核,通过一行代码提升模型性能,降低内存使用,支持更长上下文长度、更大批量大小和庞大词汇量

主要特点

易于使用:只需用一行代码修补您的 Hugging Face 模型,或者使用我们的 Liger Kernel 模块组成您自己的模型。

时间和内存效率高:与 Flash-Attn 秉承同样的精神,但适用于RMNSNorm、RoPE、SwiGLU和CrossEntropy等层!通过内核融合、就地替换和分块技术,可将多 GPU 训练吞吐量提高 20%,并将内存使用量降低 60% 。

精确:计算精确——无近似值!前向和后向传递均通过严格的单元测试实现,并在没有 Liger Kernel 的情况下针对训练运行进行收敛测试,以确保准确性。

轻量级: Liger Kernel 的依赖性极小,只需要 Torch 和 Triton — 无需额外的库!告别依赖性烦恼!

支持多 GPU:兼容多 GPU 设置(PyTorch FSDP、DeepSpeed、DDP 等)。

目标受众

研究人员:寻求使用高效可靠的内核为前沿实验构建模型。

ML 从业者:专注于通过最佳、高性能内核最大化 GPU 训练效率。

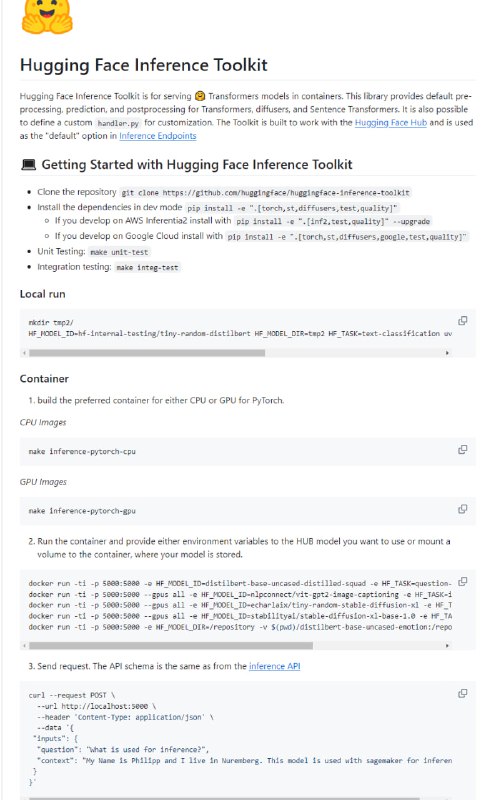

新手:渴望学习如何编写可靠的 Triton 内核以提高训练效率。 - Hugging Face 推理工具包:用于部署和提供transformer、句子transformer和扩散模型的推理服务,支持自定义处理流程,适用于多种推理平台和云服务环境

-