黑洞资源笔记

-

-

- OpenGFW:Linux 上灵活、易用、开源的 GFW 实现,并且在许多方面比真正的 GFW 更强大,可以部署在家用路由器上的网络主权,使用场景包括广告拦截、家长控制、恶意软件防护、VPN/代理服务滥用防护、流量分析 (纯日志模式)等

- 手撕大厂算法-算法刷题大课训练营 | 团购价220

- 全栈多端低代码平台项目大课-系统化掌握React生态体系 | 团购价223

- LeftoverLocals:通过GPU本地内存泄漏监听LLM响应

研究人员发现了一种新的GPU漏洞LeftoverLocals,通过该漏洞攻击者可以读取其他进程中的GPU本地内存数据。这会影响LLM等GPU应用的安全性,文章以llama.cpp为例,演示了如何通过读取本地内存来恢复LLM的响应。测试了多种平台,发现AMD、Apple和高通的GPU存在该漏洞。Nvidia和Intel等则不存在。

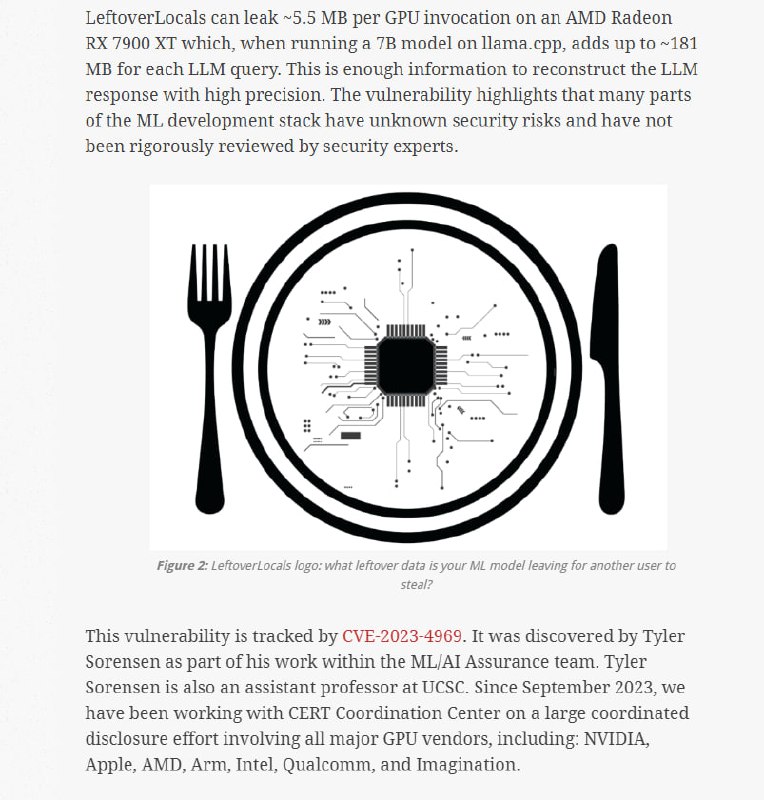

攻击者可以通过并行程序来实现该攻击,不需要特殊权限。文章详细解释了技术原理和攻击步骤。由于该漏洞的影响范围很广,作者通过CERT/CC组织进行了协调披露,以便GPU厂商修复。 - 数字人对话系统 - Linly-Talker:将大型语言模型与视觉模型相结合的智能AI系统,创建了一种全新的人机交互方式,集成了各种技术,例如Whisper、Linly、微软语音服务和SadTalker会说话的生成系统。

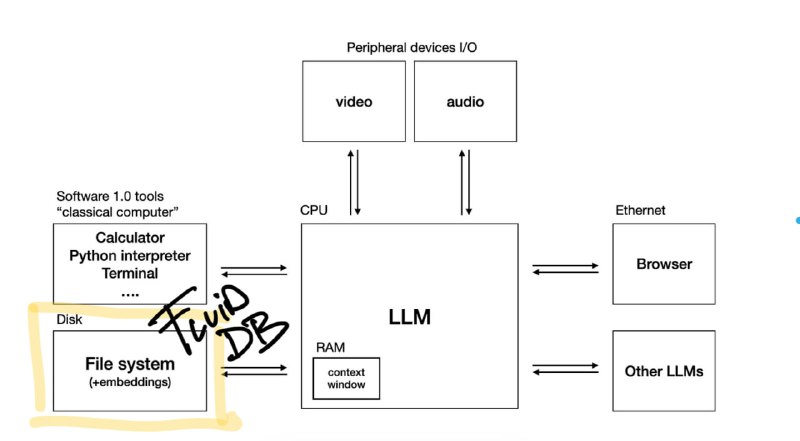

该系统部署在Gradio上,允许用户通过提供图像与AI助手进行交谈。用户可以根据自己的喜好进行自由的对话或内容生成。 - Fluid Database:可以根据摄取的数据更新其架构的“流体”自适应数据库,支持以自然语言以及半结构化格式输入数据,既支持传统查询语言,也支持直观的自然语言查询。

- SGLang:为大型语言模型(LLM)设计的结构化生成语言,旨在加速和更好地控制与LLM的交互。

特点包括:灵活的前端语言,允许轻松编程LLM应用,支持多个连锁生成调用、高级提示技术、控制流、多模式、并行处理和外部交互;具备高性能运行时,使用RadixAttention可以显著加速复杂LLM程序的执行,自动跨多个调用重复使用KV缓存,同时支持连续批处理和张量并行处理。 -

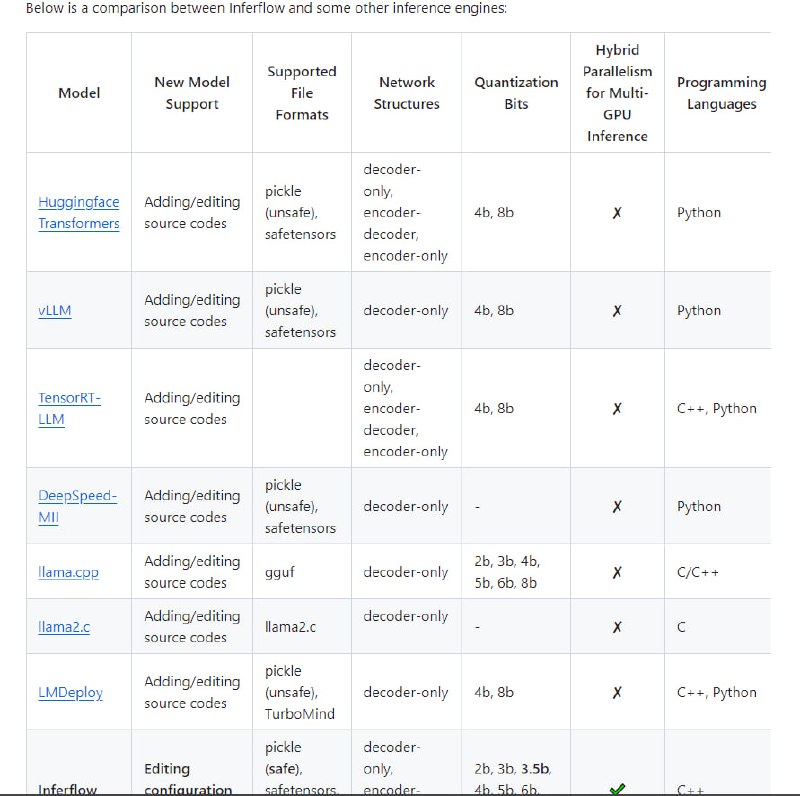

- Inferflow:高效且高度可配置的大型语言模型(LLM)推理引擎。可以通过简单修改配置文件中的几行内容,而无需编写源代码,来为大多数常见的Transformer模型提供服务。

主要特点

可扩展且高度可配置:使用 Inferflow 服务新模型的典型方法是编辑模型规范文件,但不添加/编辑源代码。我们在 Inferflow 中实现了原子构建块和技术的模块化框架,使其在组合上可推广到新模型。如果该模型中的原子构建块和技术(对于 Inferflow)“已知”,则 Inferflow 可以为该新模型提供服务。

3.5位量化:Inferflow实现2位、3位、3.5位、4位、5位、6位和8位量化。在量化方案中,3.5位量化是Inferflow推出的新方案。

多GPU推理的混合模型分区:Inferflow支持多GPU推理,具有三种模型分区策略可供选择:按层分区(管道并行)、按张量分区(张量并行)和混合分区(混合并行) )。其他推理引擎很少支持混合分区。

宽文件格式支持(并安全加载pickle数据):Inferflow支持直接加载多种文件格式的模型,而不依赖于外部转换器。支持的格式包括pickle、safetensors、llama.cpp gguf等。众所周知,使用Python代码读取pickle文件存在安全问题。通过在 C++ 中实现简化的 pickle 解析器,Inferflow 支持从 pickle 数据安全地加载模型。

广泛的网络类型支持:支持三种类型的变压器模型:仅解码器模型、仅编码器模型和编码器-解码器模型。

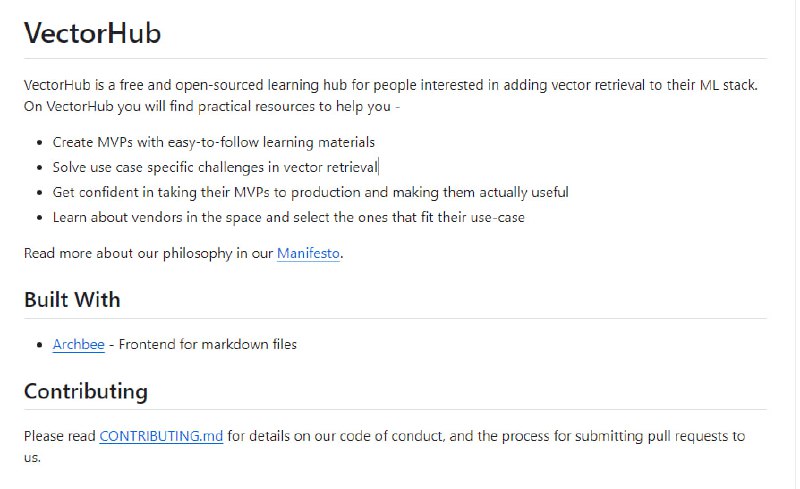

GPU/CPU混合推理:支持仅GPU、仅CPU、GPU/CPU混合推理。 - VectorHub:免费的、开源的学习网站,面向有意将向量检索加入到机器学习栈的开发人员。

-

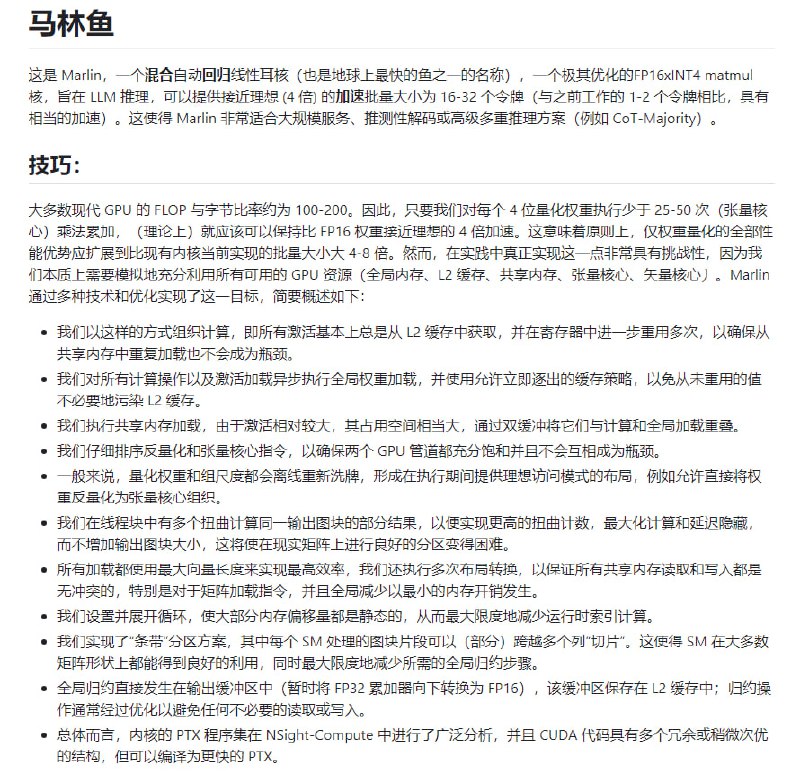

- Marlin:混合自回归线性核(Mixed Auto-Regressive Linear kernel),一个经过高度优化的FP16xINT4矩阵乘法核,用于LLM推理,可以在批量大小为16-32个token的情况下实现接近理想的约4倍加速。

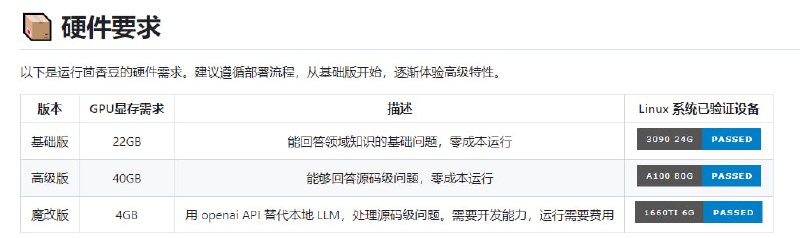

- “茴香豆”是一个基于 LLM 的领域知识助手。特点:

1.应对群聊这类复杂场景,解答用户问题的同时,不会消息泛滥

2.提出一套解答技术问题的算法 pipeline

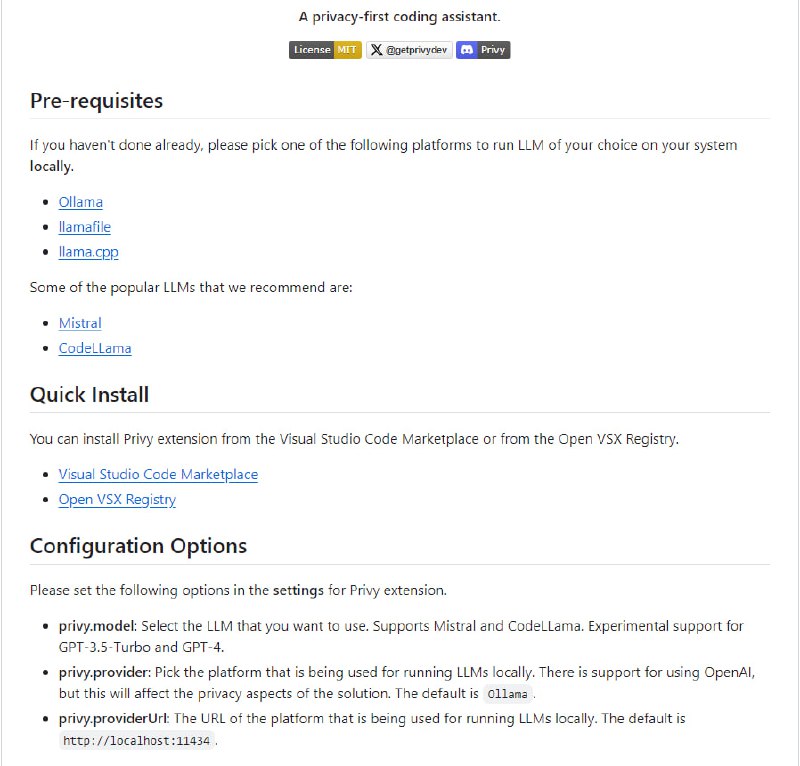

3.部署成本低,只需要 LLM 模型满足 4 个 trait 即可解答大部分用户问题 - Privy:注重隐私的编程助手,可在本地系统上运行候选平台的LLM(语言模型),可以选择Mistral、CodeLLama等热门的LLM。安装Privy扩展可以从Visual Studio Code Marketplace或Open VSX Registry进行

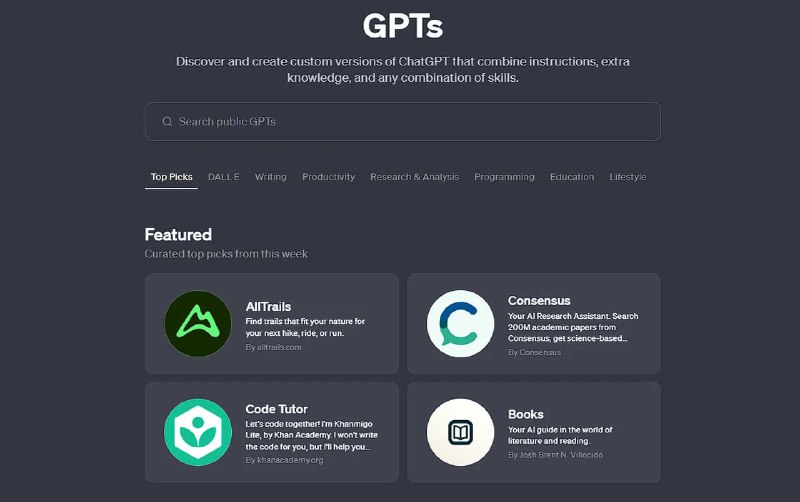

- gptstore-prompts:GPTStore上的100个热门GPTs提示,可以利用这些提示来学习和改进提示工程,学习如何构建最好、最受欢迎的 GPTS

-