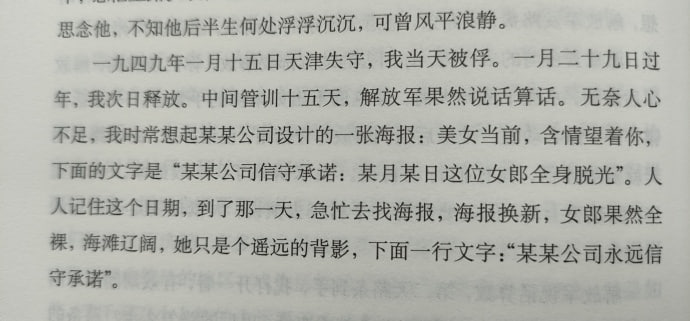

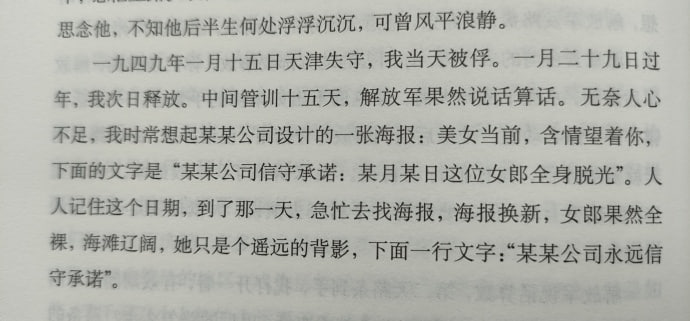

黑洞资源笔记

- ——王鼎钧《关山夺路》

- 运行 100 万个并发任务需要多少内存?| blog

在这篇博文中,作者深入探讨了在常见语言如Rust、Go、Java、C#、Python、Node.js和Elixir中,异步编程与多线程编程在内存消耗方面的对比。 - GPT 是如何工作的:200 行 Python 代码实现一个极简 GPT(2023)| blog

本文是arthurchiao整理和翻译自 2023 年 Andrej Karpathy 的 twitter 和一篇文章: GPT as a finite-state markov chain。

本文实际上是基于 PyTorch,并不是完全只用基础 Python 包实现一个 GPT。 主要目的是为了能让大家对 GPT 这样一个复杂系统的(不那么底层的)内部工作机制有个直观理解。 -

- GPTLink:10分钟搭建自己可免费商用的ChatGPT环境,搭建简单,包含用户,订单,任务,付费等功能

-

-

-

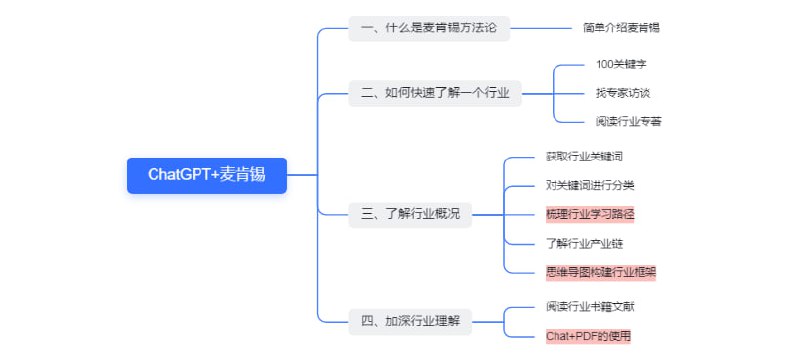

- ChatGPT+麦肯锡方法论,快速了解一个行业 | 原文阅览 | #经验

借助麦肯锡方法论了解一个行业主要是三个关键步骤:

- 第1步是总结行业的100个关键词。

- 第2步是找三五个专家访谈,了解各种行业问题。

- 第3步是找三五本行业专业书籍,仔细阅读并找出共性。

利用ChatGPT的步骤:

1. 让ChatGPT给出50个关键字,并以表格的形式呈现

2. 让ChatGPT对这些关键字进行归类,生成Markdown表格。分类后的关键字有利于我们初步建立行业的知识框架

3. 在对关键字排除优先级,以及提供参考的书籍资料。由于ChatGPT喜欢胡说八道,所以要加上“引用真实数据”

4. 可以让GPT筛选行业宏观方面内容,例如产业结构、上下游等,并形成Markdown表格

5. 可以借助“Show Me”这种导图插件生成思维导图

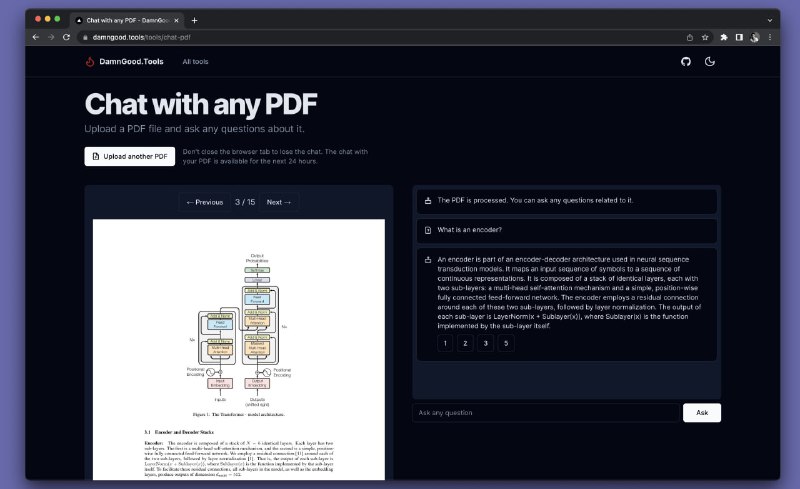

6. 可以借助“AskYourPDF”插件或者ChatDoc平台辅助阅读PDF -

- 群友投稿

手把手教你 5 分钟将公司 CEO 数字克隆装进公众号 | Link

这篇文章提供了一种方法将公司 CEO 的语料进行训练,打造了一个数字克隆版的 CEO,然后将这个数字克隆接入了微信公众号作为客服, -

- 计图大模型推理库 - 笔记本没有显卡也能跑大模型

本大模型推理库JittorLLMs有以下几个特点:

1. 成本低:相比同类框架,本库可大幅降低硬件配置要求(减少80%),没有显卡,2G内存就能跑大模型,人人皆可在普通机器上,实现大模型本地部署;是目前已知的部署成本最低的大模型库;

2. 支持广:目前支持了4种大模型:ChatGLM大模型;鹏程盘古大模型;BlinkDL的ChatRWKV;国外Meta的LLaMA大模型;后续还将支持MOSS等国内优秀的大模型,统一运行环境配置,降低大模型用户的使用门槛。

3. 可移植:用户不需要修改任何代码,只需要安装Jittor版torch(JTorch),即可实现模型的迁移,以便于适配各类异构计算设备和环境。

4. 速度快:大模型加载速度慢,Jittor框架通过零拷贝技术,大模型加载开销降低40%,同时,通过元算子自动编译优化,计算性能相比同类框架提升20%以上。

Jittor文档 | Jittor论坛 -

- Poe正式推出安卓版 | 下载地址

-