GPUStack:开源GPU集群管理器,用于运行大型语言模型(LLM),支持多种硬件平台,提供轻量Python包和OpenAI兼容API,简化用户和API密钥管理,实时监控GPU性能和利用率

黑洞资源笔记

-

-

-

-

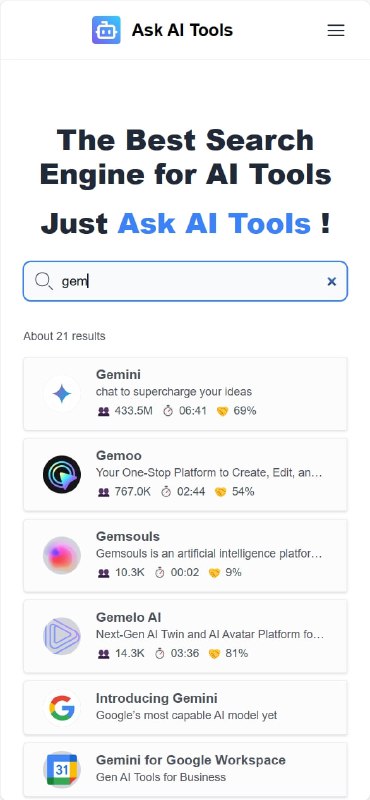

- Kubernetes上部署大型语言模型的自动化工具,支持本地快速启动和运行。支持CPU和GPU(尤其是NVIDIA和AMD)的稳定部署,但并非所有GPU都受支持

Ollama Helm Chart | #工具 -

-

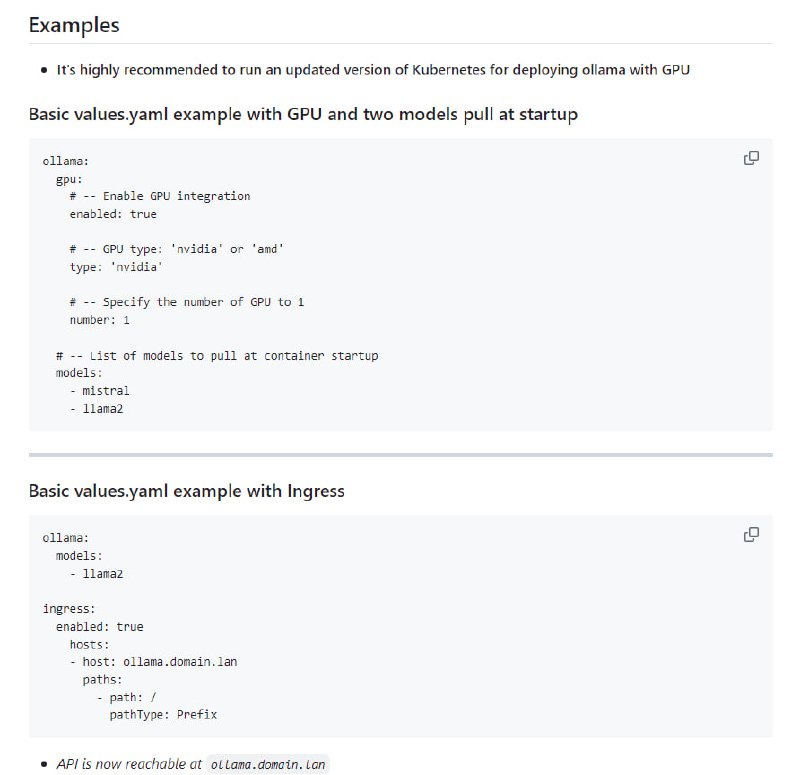

- Zenbase Core:生产环境中自动化的提示工程库,专为软件工程而设计,将斯坦福NLP的DSPy项目研究成果转化为实际工程需求,帮助开发者在生产环境中部署自动提示优化

-

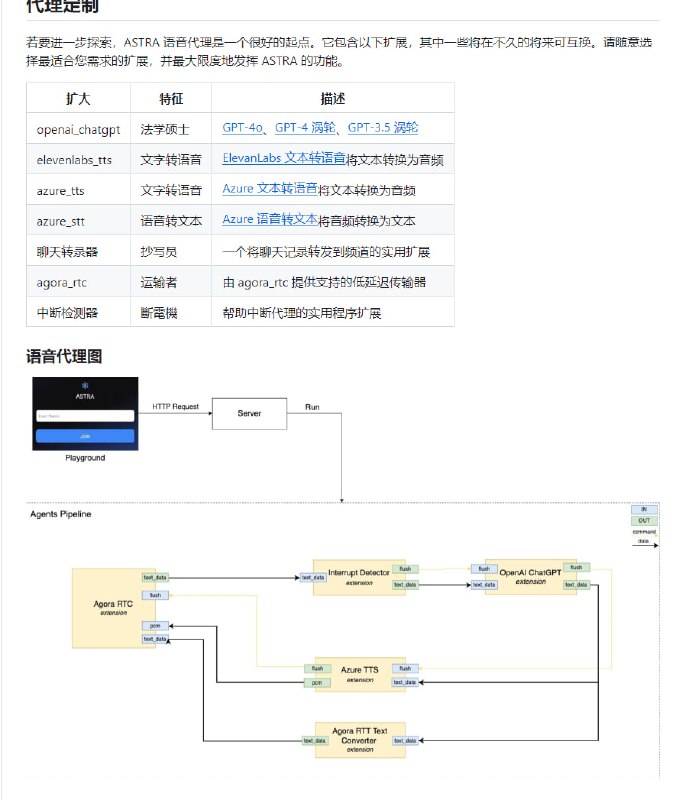

- ASTRA.ai:无需编码知识的快速工作流构建器,支持多模态交互和高度可定制的扩展,使用直观

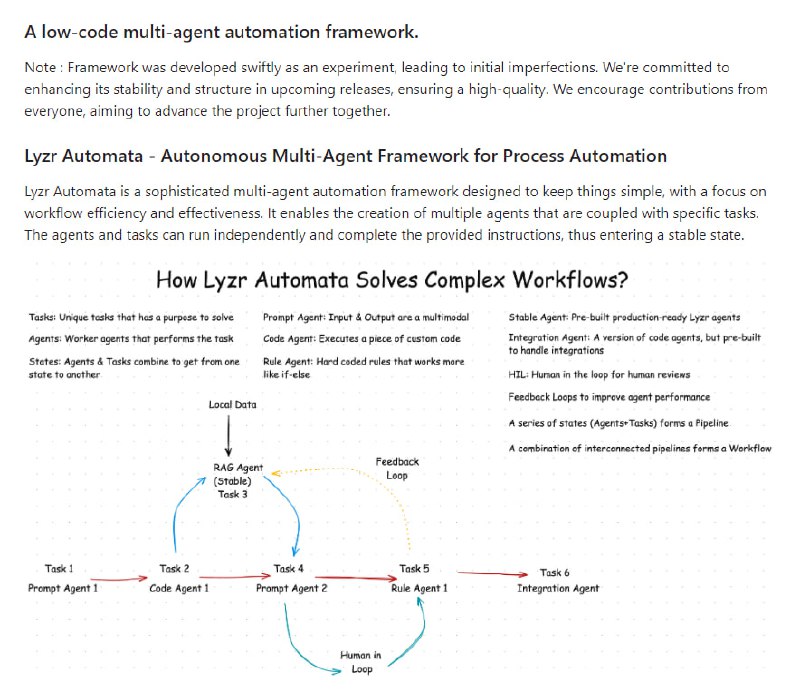

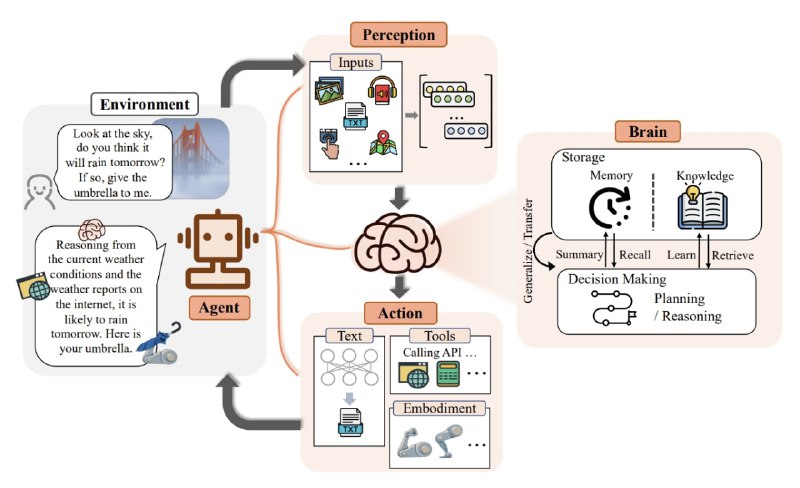

- Awesome-AI-Agents:由LLM驱动的自主Agent集合,涵盖任务解决、多智能体协作、社会模拟等项目,提供框架、基准评估和相关资源,推动AI代理技术的发展

-

-

-

-

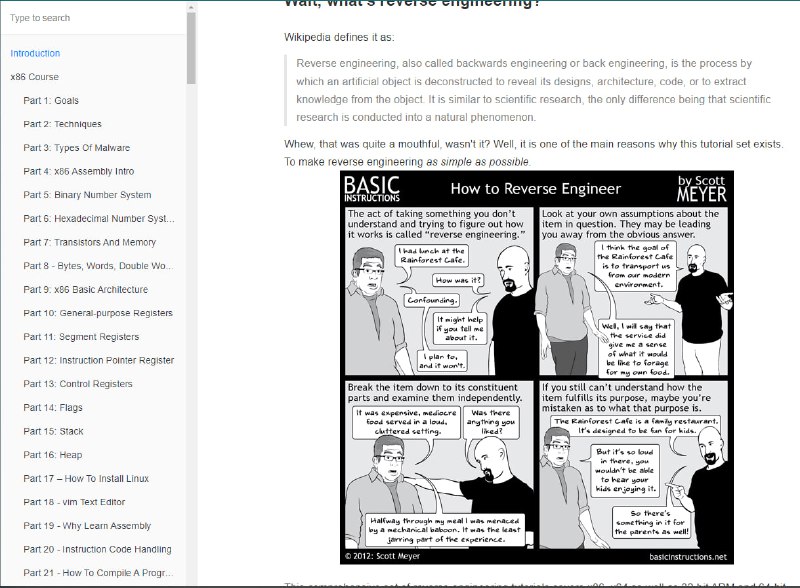

- 《适合所有人的逆向工程》 | #电子书

这套全面的逆向工程教程涵盖 x86、x64 以及 32 位 ARM 和 64 位架构。如果你是想要学习倒车的新手,或者只是想复习一些概念,那么你来对地方了。

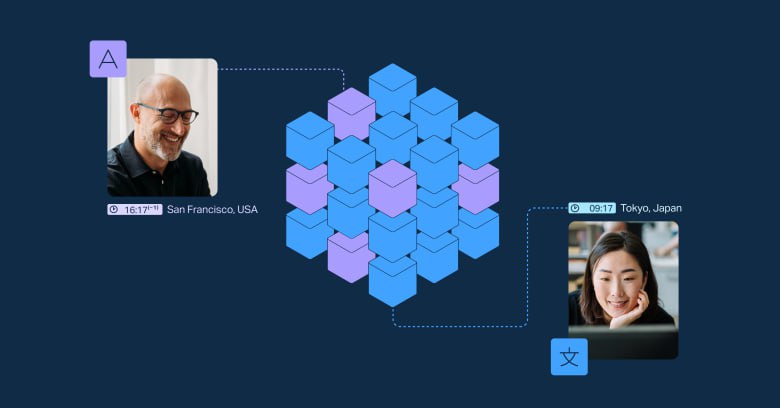

作为初学者,这些教程将带你从零开始掌握逆向工程的中级基础知识,这是网络安全领域的每个人都应该具备的技能。如果你来这里只是为了刷新一些概念,可以使用侧边栏来查看到目前为止已涵盖的部分。 - DeepL新一代语言模型:超越Google、ChatGPT-4和微软的翻译质量,提供更少编辑需求的高效翻译工具,专为企业级翻译和内容创作设计。

专业语言专家的模糊测试显示,DeepL新语言模型的翻译质量优于Google Translate、ChatGPT-4和Microsoft这些竞争对手1.3-2.3倍。

DeepL语言模型利用自主研发的突破性AI技术和7000多万优选训练数据,专门针对翻译进行优化设计。支持日语、德语和中文与英语之间的互译,翻译质量较早期模型提升1.4-1.7倍。翻译需要的编辑次数也比竞争对手少2-3倍。

DeepL新语言模型能提高知识工作者的工作效率,降低翻译和文案编辑的时间,为企业节省时间和成本。模型具备企业级安全性,承诺不会将用户数据用于模型训练。

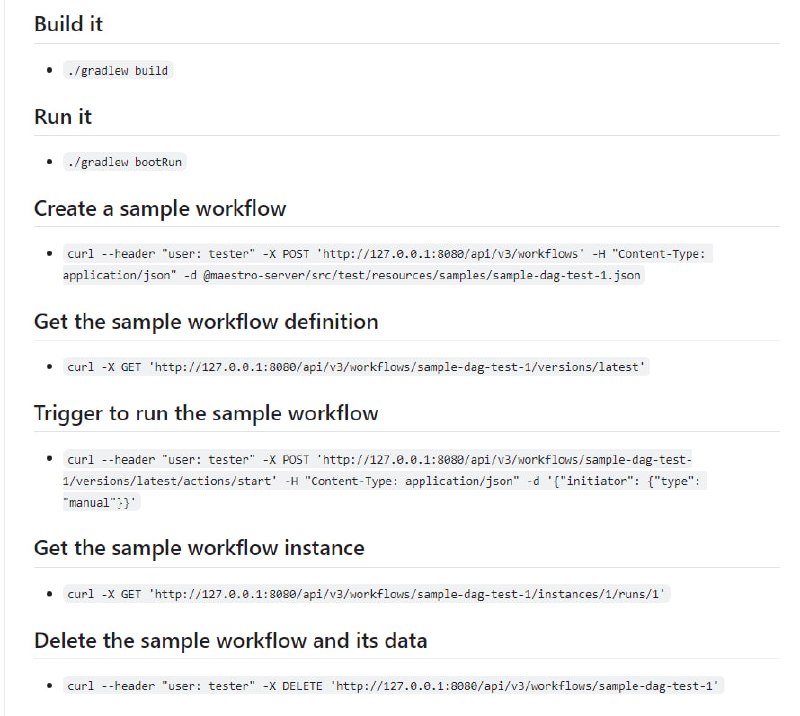

DeepL专业用户可以一键切换新旧语言模型。企业用户可以考虑升级使用该模型,获得更高质量的翻译。 - Maestro:Netflix的工作流编排器,为数据平台用户提供全托管的工作流即服务,支持大规模工作流和作业调度,具备高可扩展性和易用性