黑洞资源笔记

-

- Python应用程序打包工具:简化Python项目打包流程,一键生成可独立运行的程序包,无需安装Python环境即可在其他机器上运行

-

-

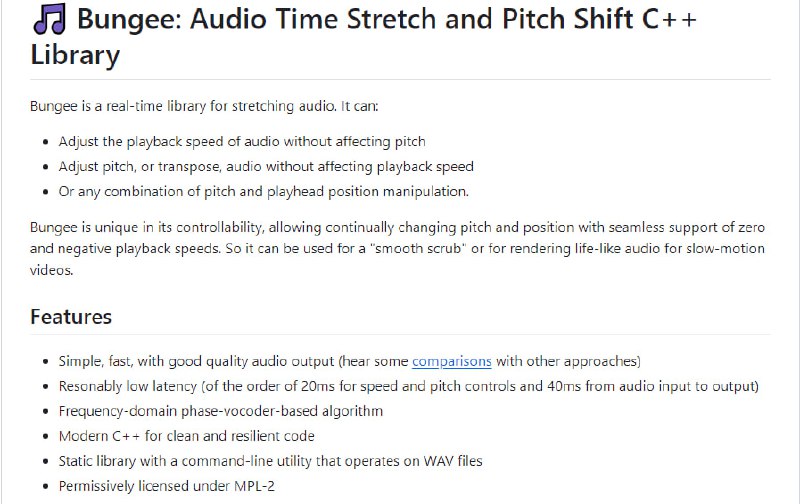

- Bungee-音频处理库:实时音频伸缩与音高变换的C++库,支持无影响音高的音频播放速度调整和不影响播放速度的音高调整,以及音高与播放位置的任意组合操作

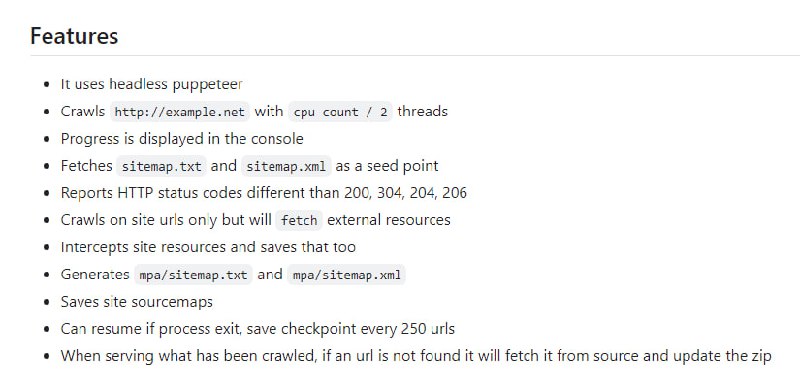

- Multi-Page Application Archive-多页面应用归档工具:将多页面应用爬取至zip文件并从zip文件提供服务,适用于站点生成器,支持JavaScript渲染内容的保存

- ComfyUI_Fill-Nodes:多功能图像和视频处理工具,提供多样化的节点编辑功能,支持从目录随机加载图片、图像字幕保存、像素化处理等,助力用户快速开发创意项目 | #工具

-

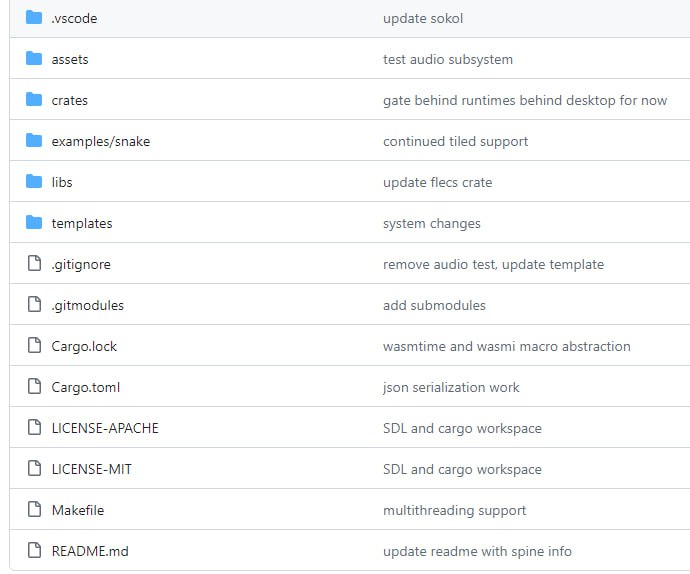

- Toxoid Engine:跨平台、模块化、数据驱动的游戏引擎,支持C Sharp、JavaScript和Rust语言脚本,具备热加载、WebGPU渲染和Web目标支持,适用于UGC游戏和多人在线沙盒RPG开发

- 表情包视觉数据集:基于AI图像解析能力的社交媒体表情包标注工具,提供丰富的表情包资源和智能体体验,简化社交媒体内容的创作和分享过程

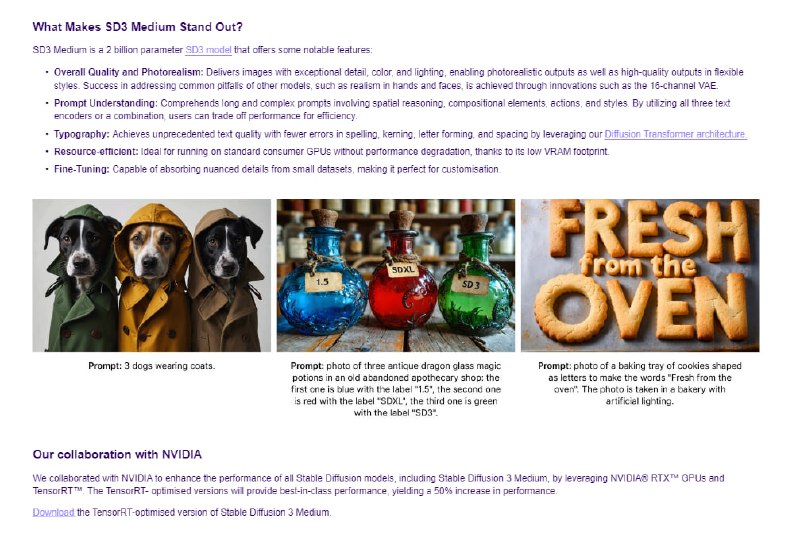

- Stable Diffusion 3 Medium:Stability AI最新推出的高级文本到图像AI模型,适合在消费级PC、笔记本及企业级GPU上运行,有望成为文本到图像模型的新标准

- Stability AI公开发布了Stable Diffusion 3 Medium图像生成模型,这是目前该公司最先进的开源文本到图像模型。

- Stable Diffusion 3 Medium是一个20亿参数量的模型,相比之前的模型有显著改进:整体图像质量和逼真度大幅提升,能够生成高质量的照片逼真图像;理解长难句子描述的能力增强;文字质量也有很大提升,减少拼写、字间距等错误。

- 该模型大小适中,非常适合在普通消费级PC和笔记本电脑上运行,也能在企业级GPU上充分发挥性能。它有望成为文本到图像模型的新标准。

- Stable Diffusion 3 Medium在Stability非商业研究社区许可证下对外开源。对于商业用途,鼓励使用新的Creator许可证。大规模商业使用还需联系Stability取得企业许可证。

- 用户可以通过Stability的API、Stable Assistant和Stable Artisan等渠道试用Stable Diffusion 3 Medium。

- Stability AI表示会根据用户反馈持续改进该模型,扩展其功能,提升性能。目标是为艺术创作和业余用户都设定一个新的标准。

- Stability AI坚持开放和负责任的AI实践,在模型的训练、测试、部署等各个阶段采取合理措施防止模型被恶意滥用。 - AI系统红队测试方法:提升AI系统安全性与可靠性的关键工具,通过对抗性测试技术识别潜在漏洞,为AI开发者、政策制定者和组织提供了多样化的红队测试方法和实践案例,以促进AI测试生态系统的健康发展

- 红队测试是评估AI系统安全性和可靠性的重要工具,通过对技术系统进行对抗性测试来识别潜在漏洞。

- AI领域目前红队测试方法不统一,使得很难客观比较不同AI系统的相对安全性。需要建立系统性红队测试的共识和标准。

- 文章介绍了多种红队测试方法,每种都有自己的优势和挑战,可以整合到从定性到定量的迭代测试流程中。

- 域专家红队可以利用专业知识识别复杂的上下文相关风险。可扩展到不同语言和文化背景的测试。

- 使用语言模型自动生成对抗样本可以提高测试效率。可以建立红队蓝队框架,迭代提升系统鲁棒性。

- 多模态红队测试可以识别新模态带来的风险。公开的社区红队测试可以汇集更广泛的观点。

- 红队结果可以转化为定量评估指标,并围绕其不断改进系统。需要政策支持红队测试的标准化和采纳。

- 红队测试是确保AI系统安全的重要手段之一。需要多个利益相关方参与,建立行业共识,推动AI的负责任发展。 - 专为智能手机设计的高性能大型语言模型推理框架,支持高达47B参数的MoE模型,速度高达每秒11.68个token,比现有框架快22倍。即使在7B模型上,通过在手机上放置50%的FFN权重,也能保持领先速度

PowerInfer-2 | #框架