黑洞资源笔记

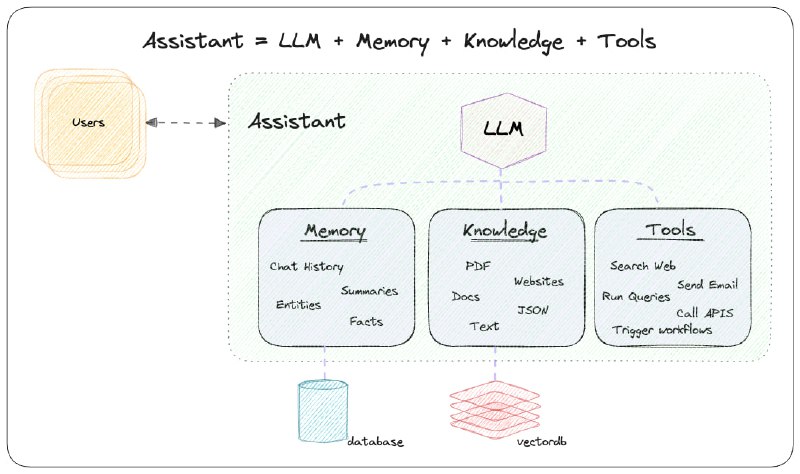

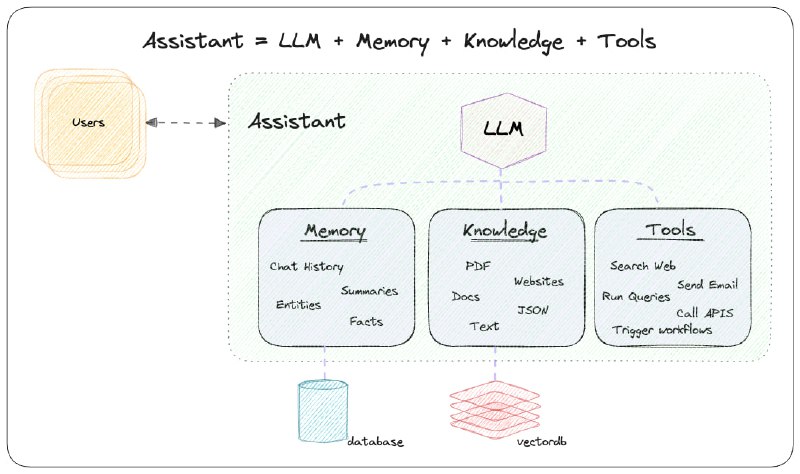

- phidata:为 LLM 添加长期记忆,旨在解决 LLM 有限的上下文和无法采取行动的问题

-

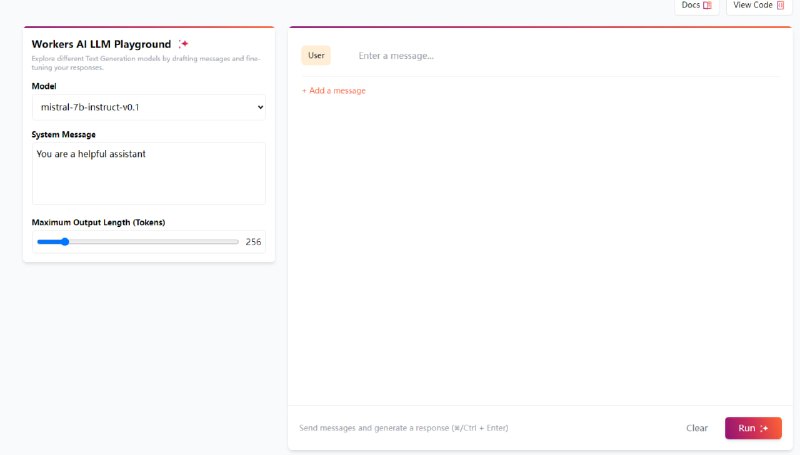

- Cloudflare的大模型试炼场,提供包括LLaMa-3-8B在内的多个13B以下模型的在线试用

- torchtitan:用于大规模语言模型(LLM)训练的原生PyTorch库

- SkipDB & Watermark & Txn:嵌入式、内存中、零拷贝、ACID、MVCC、几乎无锁且提供可序列化快照隔离的数据库引擎

-

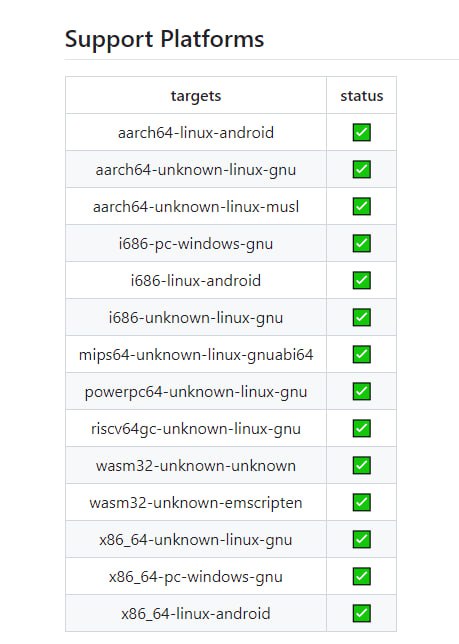

- Swan:使用FPGA的轻量级语言模型执行环境,目标是利用高级综合(HLS)在通用FPGA上高效地运行语言模型

-

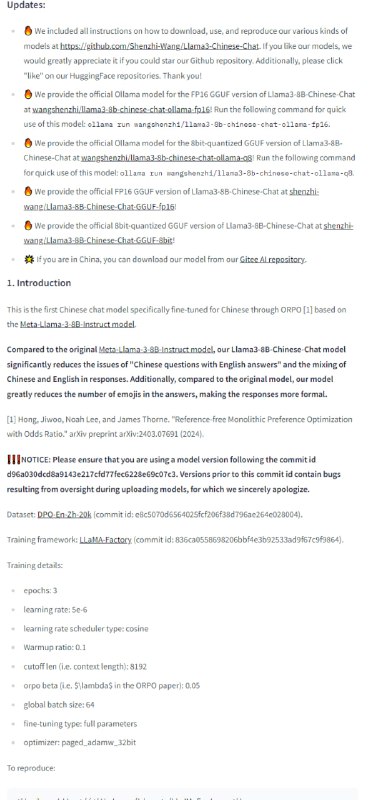

- Llama3-8B-Chinese-Chat:首个中文微调LLaMa 3模型,基于 Meta-Llama-3-8B-Instruct 模型,使用 ORPO 对其进行了中文微调,从而提高了其在中文问答中的表现

-

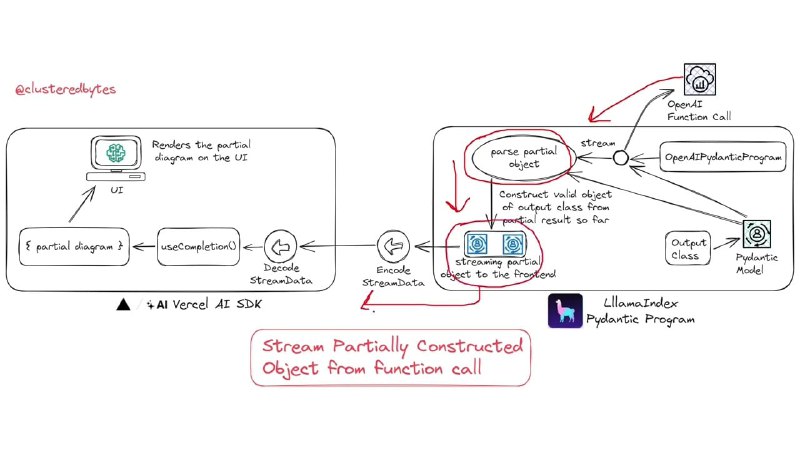

- AI 流程图生成器,使用 LlamaIndex 和 Vercel AI SDK 构建的 AI 图表生成器,可以根据给定的主题生成图表,并在生成过程中实时流传输部分图表

ai-diagram-generator | #生成器 - Empirical:快速测试和评估 LLM、提示和其他配置,适用于应用的所有重要场景

- seemore:用 PyTorch 从头开始实现的视觉语言模型

- CoreNet: Apple的深度网络训练库,用于训练深度神经网络,支持各种任务,包括基础模型(如 CLIP 和 LLM)、目标分类、目标检测和语义分割

- 微信发布一款桌面工作效率的AI工具:小微助手,可搜索电脑中所有内容。| #工具

通过你对该工具的授权,它可以使用自然语言搜索你电脑里指定文件夹的所有内容,同时还支持在线聊天问答,类似ChatGPT。

还有一个圈子功能允许组织成员共同分享和使用各种数据和服务,还能接入OpenAI等模型。

同时还内置多种应用,如剪贴板收藏、微信翻译、闪念胶囊工具。 - Adobe 正式宣布推出新的图像生成模型 Firefly Image 3,即日起在 Firefly Web 应用程序、Adobe Photoshop 和 Adobe InDesign 中提供测试版,并在「今年晚些时候」全面上市,旨在让创作者能够提高工作效率,生成更高质量、更详细的图像。 | 详文

- 2024【新】零声linuxC++高级开发

- 用 ORPO 将 Llama 3 的性能提升到新高度 | 详文

ORPO(Odds Ratio Preference Optimization)是一种新的微调技术,可以将传统的监督微调和偏好对齐阶段合并为一个过程,从而减少计算资源和训练时间。

ORPO通过修改语言建模目标,将负对数似然损失与比值(OR)项相结合,以弱化被拒绝的响应并强化被选择的响应,让模型同时学习目标任务和人类偏好。

文章使用TRL库中的ORPOTrainer在Llama 3 8B模型上进行ORPO微调,数据集包含DPO偏好对,共1000个样本。尽管由于样本量少仅训练了1个epoch,但微调后的模型在Nous的基准测试中表现良好,所有指标上均优于Llama 3原模型。

ORPO展现了作为新的微调范式的潜力,未来在更大规模的偏好数据集上进行充分训练将产生更好的效果。选择高质量的数据集也非常重要。

当前是开源社区的活跃时期,正在发布越来越多高质量的开源模型,开源模型与专有模型的差距正在缩小,微调是获得最佳性能的关键。 -