用 ORPO 将 Llama 3 的性能提升到新高度 |

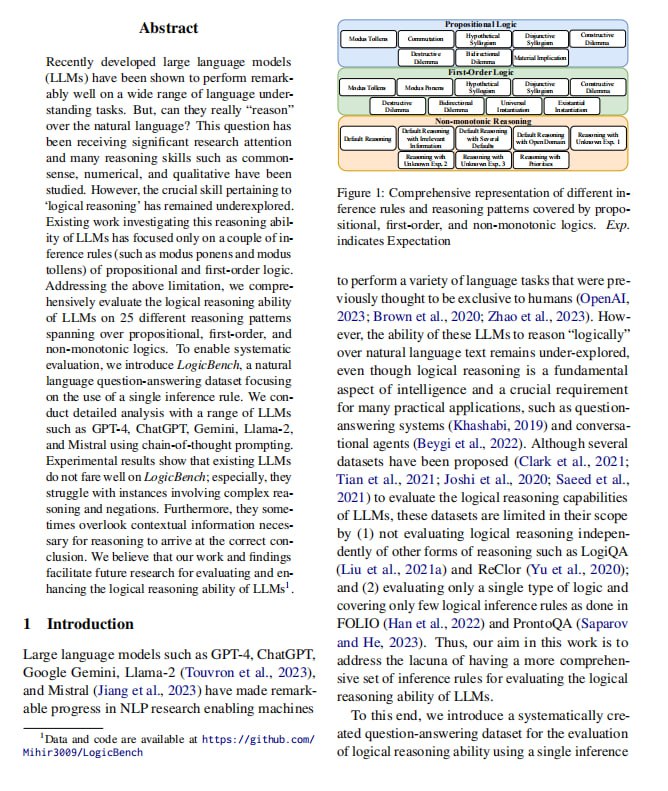

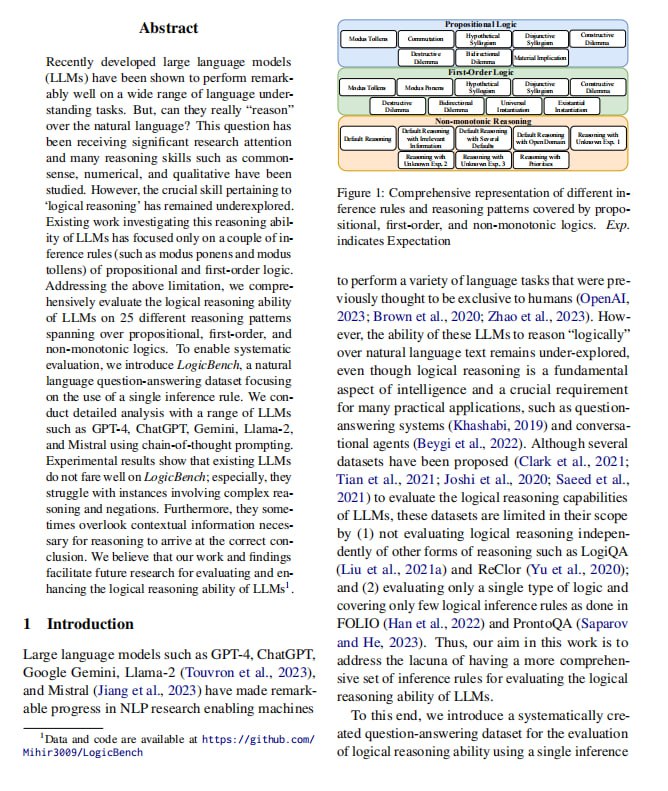

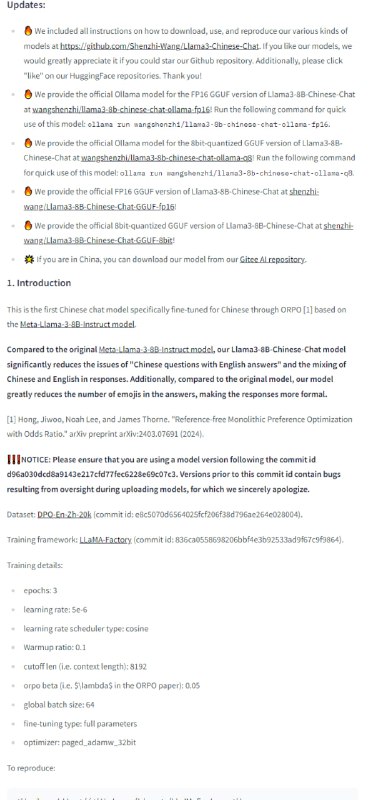

详文ORPO(Odds Ratio Preference Optimization)是一种新的微调技术,可以将传统的监督微调和偏好对齐阶段合并为一个过程,从而减少计算资源和训练时间。

ORPO通过修改语言建模目标,将负对数似然损失与比值(OR)项相结合,以弱化被拒绝的响应并强化被选择的响应,让模型同时学习目标任务和人类偏好。

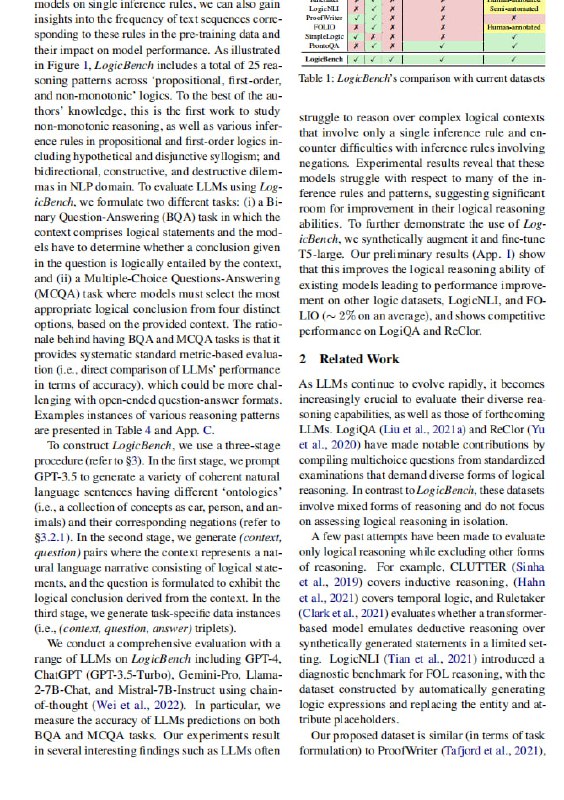

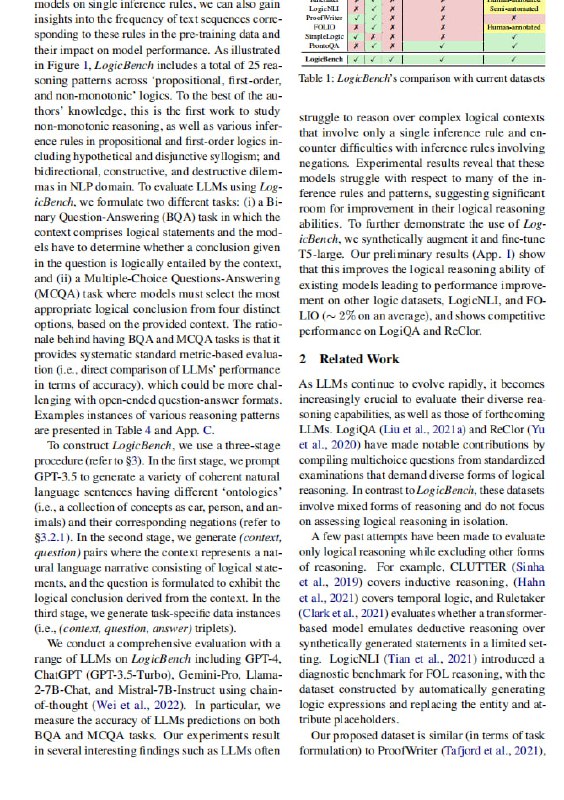

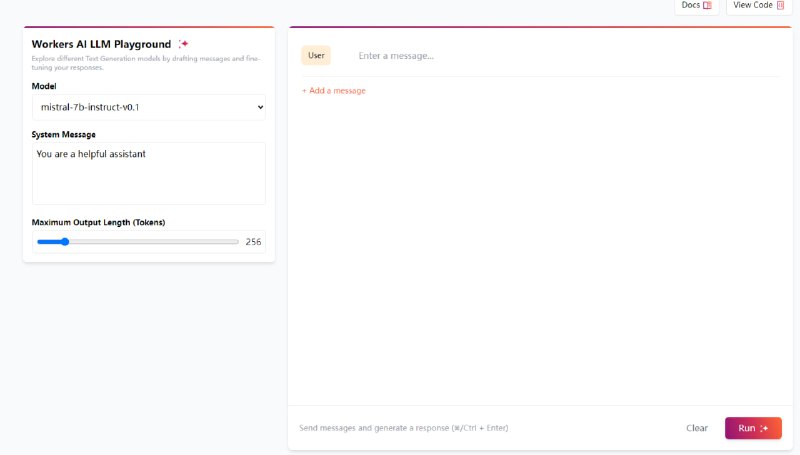

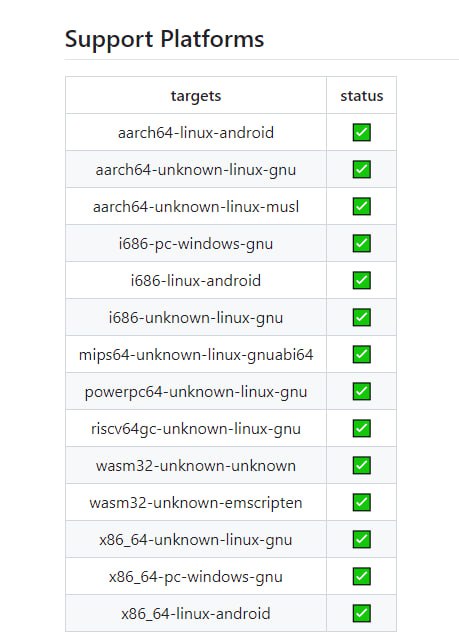

文章使用TRL库中的ORPOTrainer在Llama 3 8B模型上进行ORPO微调,数据集包含DPO偏好对,共1000个样本。尽管由于样本量少仅训练了1个epoch,但微调后的模型在Nous的基准测试中表现良好,所有指标上均优于Llama 3原模型。

ORPO展现了作为新的微调范式的潜力,未来在更大规模的偏好数据集上进行充分训练将产生更好的效果。选择高质量的数据集也非常重要。

当前是开源社区的活跃时期,正在发布越来越多高质量的开源模型,开源模型与专有模型的差距正在缩小,微调是获得最佳性能的关键。