AIlice是一个正在开发的轻量级AI Agent,它也可以作为一个简单的开发框架,用于快速构建和试验各种AI Agent想法。特点如下:

自然且高度容错的交互式代理调用树架构。

以最灵活的方式解析 LLM 输出,支持更多样的函数调用机制。

自构建、动态加载环境交互模块,提供无限的功能扩展潜力。

专为开源模型设计,但无缝支持 GPT-4 等商业模型。

支持对特定主题的深入调查。

自动化编程和脚本执行。它是一个包罗万象的编码器和熟练的系统管理工具,掌握所有系统命令——类似于人工智能操作系统。

设计AIlice时的基本原则是:

以高度动态的提示构建机制丰富LLM行为;

尽可能分离不同的计算任务,利用传统计算中的递归和分治法来解决复杂问题。

代理应该能够双向交互。

让我们简要解释一下这些基本原则。

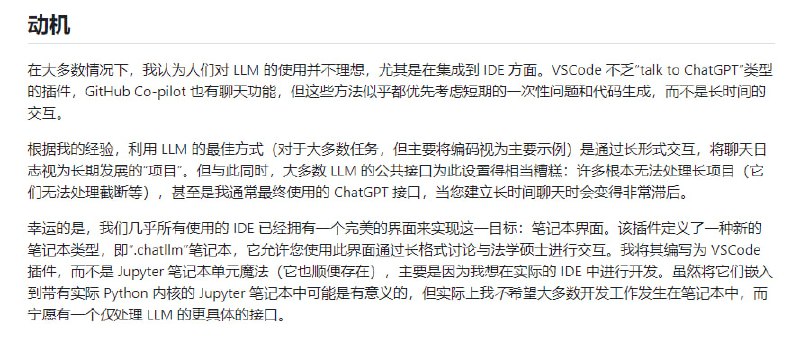

从最明显的层面开始,高度动态的提示结构使得代理不太可能陷入循环。外部环境新变量的涌入不断影响着法学硕士,帮助其避免陷入这种陷阱。此外,向法学硕士提供所有当前可用的信息可以大大提高其产出。例如,在自动化编程中,来自解释器或命令行的错误消息帮助法学硕士不断修改代码,直到获得正确的结果。最后,在动态提示构建中,提示中的新信息也可能来自其他智能体,作为一种联动推理计算的形式,使得系统的计算机制更加复杂、多样,能够产生更丰富的行为。

从实际的角度来看,分离计算任务是由于我们有限的上下文窗口。我们不能指望在几千个代币的窗口内完成一项复杂的任务。如果我们能够分解一个复杂的任务,以便在有限的资源内解决每个子任务,那将是一个理想的结果。在传统的计算模型中,我们一直利用这一点,但在以LLM为中心的新计算中,这并不容易实现。问题是,如果一个子任务失败,整个任务就有失败的风险。递归更具挑战性:如何确保每次调用时,LLM 都能解决部分子问题,而不是将整个负担传递给下一级调用?我们在AIlice中用IACT架构解决了第一个问题,第二个问题理论上不难解决,但很可能需要更聪明的LLM。

第三个原则是大家目前正在努力的:让多个智能代理交互、协作来完成更复杂的任务。这一原则的实现实际上解决了前面提到的子任务失败的问题。多智能体协作对于智能体运行中的容错能力至关重要。事实上,这可能是新计算范式与传统计算最大的区别之一:传统计算是精确且无错误的,仅通过单向通信(函数调用)来分配子任务,而新计算范式则容易出错且需要计算单元之间的双向通信来纠正错误。这将在下面有关 IACT 框架的部分中详细解释。