黑洞资源笔记

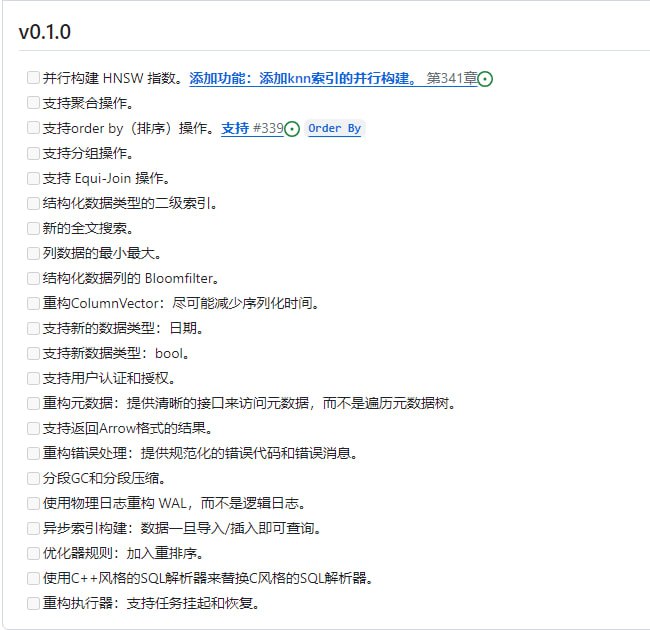

- Infinity:AI原生数据库,为LLM应用提供了极快的向量和全文搜索能力,具有高性能、灵活性和易用性等特点,能满足下一代AI应用的挑战

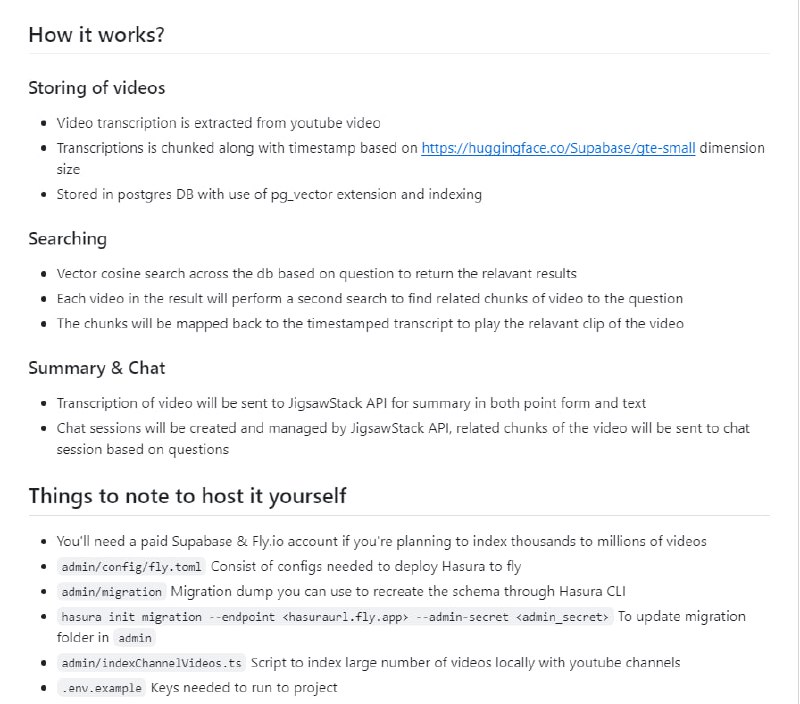

- 使用最新的AI工具驱动的视频搜索引擎,利用视频转录和向量搜索技术,让用户能根据问题快速找到相关的视频片段。

该项目使用了Supbase、Hasura、Fly、JigsawStack和Vercel等技术构建,具有高效、可扩展和易用的特点。

AI Video Search Engine (AVSE) | #搜索引擎 -

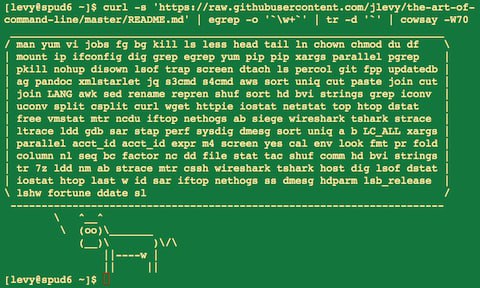

- 熟练使用命令行是一种常常被忽视,或被认为难以掌握的技能,但实际上,它会提高你作为工程师的灵活性以及生产力。

本文是一份作者在 Linux 上工作时发现的一些命令行使用技巧的摘要。有些技巧非常基础,有的则相当复杂,甚至晦涩难懂。这篇文章并不长,但当你能够熟练掌握这里列出的所有技巧时,你就学会了很多关于命令行的东西了。

这篇文章不仅能帮助刚接触命令行的新手,而且对具有经验的人也大有裨益。本文致力于做到覆盖面广(涉及所有重要的内容),具体(给出具体的最常用的例子),以及简洁(避免冗余的内容,或是可以在其他地方轻松查到的细枝末节)。在特定应用场景下,本文的内容属于基本功或者能帮你节约大量的时间。

本文主要为 Linux 所写,但在仅限 OS X 系统章节和仅限 Windows 系统章节中也包含有对应操作系统的内容。除去这两个章节外,其它的内容大部分均可在其他类 Unix 系统或 OS X,甚至 Cygwin 中得到应用。

本文主要关注于交互式 Bash,但也有很多技巧可以应用于其他 shell 和 Bash 脚本当中。除去“标准的”Unix 命令,还包括了一些依赖于特定软件包的命令(前提是它们具有足够的价值)。

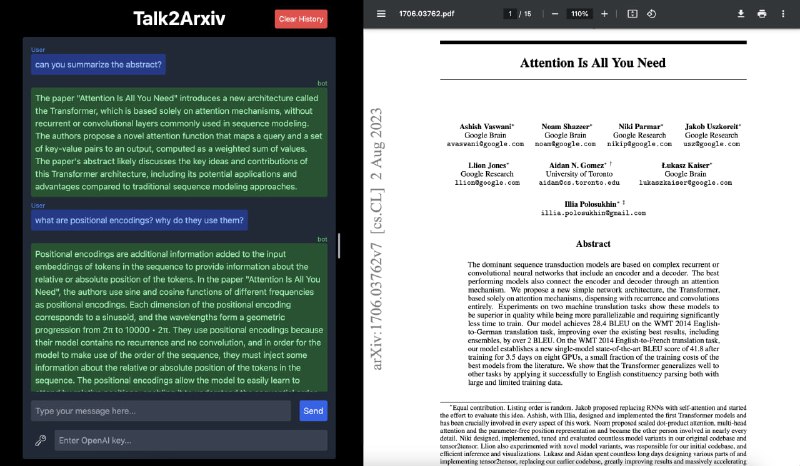

命令行的艺术 | #命令行 - 在 arxiv.org 链接前面加上“talk2”,可直接针对论文内容进行问答(需要自备OpenAI key)| github

Talk2Arxiv 是专为学术论文 PDF 构建的开源 RAG(检索增强生成)系统,由talk2arxiv 服务器提供支持

特征

PDF 解析:利用 GROBID 从 PDF 中高效提取文本。

分块算法:用于最佳文本分块的定制算法。按逻辑部分(简介、摘要、作者等)进行分块,并且还利用递归细分分块(块为 512 个字符,然后是 256 个字符,然后是 128 个字符......)

文本嵌入:使用 Cohere 的 EmbedV3 模型进行准确的文本嵌入。

矢量数据库集成:使用 Pinecone 来存储和查询嵌入。这也可以缓存研究论文,因此论文只需要嵌入一次。

上下文相关性:采用重新排名过程来根据用户输入选择最相关的内容。 -

- 面向Agent的功能强大的搜索引擎,可以在本地运行或通过远程API连接,适用于大型语言模型(LLM)和人类用户,提供超过十亿个来自Creative Commons、Arxiv、维基百科和Project Gutenberg等多样化来源的高质量嵌入。

AgentSearch [ΨΦ] | #搜索引擎 - Texify:将数学公式图片转换为markdown/LaTeX格式,具有OCR功能,可以处理内联和块级数学公式。

-

- PenX:结构化的个人笔记应用,着重于保护隐私,采用端到端加密来同步数据,代码开源可信

- 新手LLM训练详细指南 | #指南

- Transformer是训练语言模型最常用的架构。预训练再微调是训练语言模型的主要方法。

- 微调需要收集任务特定的数据集,一般大小在几十MB到几GB。

- 数据预处理非常重要,需要将数据清理成合适的格式,如JSONL。

- 主要的训练超参数包括batch size、epoch数、学习率、梯度累积步数等。

- LoRA是一种减少GPU内存占用的微调方法,QLoRA则通过量化进一步降低了内存需求。

- 学习曲线可以诊断模型的训练情况,判断是否欠拟合、过拟合或拟合良好。

- 模型量化可以降低模型大小,使大模型也能在低显存环境下使用。

- 模型适配器方法可以进行个性化微调而不加载整个模型。

- 模型融合可以组合多个模型的优势得到更优的单模型。

- 合理配置训练超参数以及诊断学习曲线对获得期望的模型至关重要。 - 如何使用Qdrant向量储存工具做一个完全本地化的 RAG 生成应用。| bolg

-

- 《写作这回事:创作生涯回忆录》豆瓣8.9分,是美国著名小说家斯蒂芬·金的一部非虚构作品,它既是金的个人回忆录,也是他的写作课程。这本书完整地体现了斯蒂芬·金的创作观点和方法,他的写作建议基于自己真实的写作和生活经历。

斯蒂芬·金是当今世界读者最多,声名最大的美国小说家之一,他的作品包括恐怖小说、科幻小说、奇幻小说等多种类型,但他的作品又远远超出了类型小说的范畴,他的作品深入内心、逼问人性、展现灵魂,他是位不折不扣的文学大师。

在《写作这回事:创作生涯回忆录》中,斯蒂芬·金分享了他的童年经历,初为作家的岁月,成名后与酒精的斗争,以及1999年险些命丧车祸的经历。他坦言,写作对他来说好比是一种信念坚持的行动,是面对绝望的挑衅反抗。

这本书的行文生动、幽默,还带着点自嘲,献给粉丝、作家和热爱好故事的人,将给所有读过的人带来乐趣和力量。 -